导图社区 《投资中最简单的事》读书笔记

- 251

- 40

- 20

- 举报

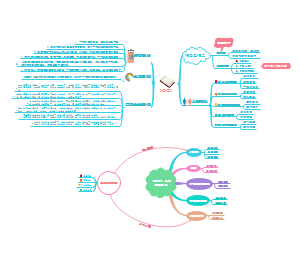

《投资中最简单的事》读书笔记

高毅资产董事长邱国鹭从多年投资的自身经验出发,剖析了“便宜才是硬道理”“定价权是核心竞争力”“人弃我取,逆向投资”“投资应该数月亮,胜而后求战”等简单易行的投资原则,阐明了“对于大多数人而言,只有价值投资才是真正可学、可用、可掌握的”这一观点,分享了易于普通投资者学习、操作的投资方法。在对“投资中最简单的事”娓娓道来的过程中,作者用生动晓畅的语言分享了自己投资生涯中的丰富投资实例,使本书兼具了易读性与实操性!

编辑于2024-02-28 17:53:43- 本质

- 投资中最简单的事

- 《因为独特》读书笔记

这不是一本枯燥的商业教材,而是泡泡玛特创始人王宁的“创业真心话”。从郑州西亚斯学院的普通学生,到打造出Molly、LABUBU等现象级IP的企业家,王宁在书中坦诚分享了创业路上的迷茫与坚持。书中强调,独特性是个人在世间立足的根本。在标准化教育和社会规训下,许多人逐渐磨平了个性棱角,沦为“大众”的一员。然而,每个人生来就具备与众不同的特质,这些特质是我们的闪光点,也是区别于他人的关键。只有勇敢展现独特自我,不随波逐流,才能走出一条属于自己的精彩人生之路。像那些在各自领域取得卓越成就的人,无不是凭借独特见解和行事风格脱颖而出。于企业而言,独特性是赢得市场竞争的核心法宝。在产品泛滥的时代,同质化只会让企业陷入价格战的泥沼。唯有塑造独特的品牌形象、开发独具特色的产品或服务,才能吸引消费者的目光,建立稳定的客户群体。例如一些小众品牌,以独特的设计和精准的定位,在细分市场中占据一席之地。李翔还指出,独特性并非与生俱来就完美无缺,而是需要不断挖掘和培养。个人要持续学习、广泛探索,在实践中发现自己的兴趣和优势;企业要加大研发投入,鼓励创新,营造包容失败的文化氛围。

- 《控糖革命》读书笔记

在这个糖分泛滥的时代,血糖控制对于我们的健康至关重要。这本书就像是一本控糖的宝典,帮助我们更好地管理血糖,享受健康生活。不仅是一本控糖指南,更是一种健康生活方式的倡导。学会控糖,让我们远离血糖波动带来的困扰,迎接更加健康和活力的生活吧!快去阅读这本书,让你的健康掌握在自己手中!

- 《可能性的艺术》读书笔记

这本书从民主问责与国家能力双维度解析政治发展,涵盖全球化、政治转型、国家建构等五大主题。通过瑞典、丹麦等发达国家及南非、伊拉克等发展中国家的案例对比,揭示不同体制的治理逻辑与转型困境。书中将复杂政治理论转化为大众可理解的洞察,帮助读者以“抽离”视角理解社会现象,提供看待世界的全新尺度!

《投资中最简单的事》读书笔记

社区模板帮助中心,点此进入>>

- 《因为独特》读书笔记

这不是一本枯燥的商业教材,而是泡泡玛特创始人王宁的“创业真心话”。从郑州西亚斯学院的普通学生,到打造出Molly、LABUBU等现象级IP的企业家,王宁在书中坦诚分享了创业路上的迷茫与坚持。书中强调,独特性是个人在世间立足的根本。在标准化教育和社会规训下,许多人逐渐磨平了个性棱角,沦为“大众”的一员。然而,每个人生来就具备与众不同的特质,这些特质是我们的闪光点,也是区别于他人的关键。只有勇敢展现独特自我,不随波逐流,才能走出一条属于自己的精彩人生之路。像那些在各自领域取得卓越成就的人,无不是凭借独特见解和行事风格脱颖而出。于企业而言,独特性是赢得市场竞争的核心法宝。在产品泛滥的时代,同质化只会让企业陷入价格战的泥沼。唯有塑造独特的品牌形象、开发独具特色的产品或服务,才能吸引消费者的目光,建立稳定的客户群体。例如一些小众品牌,以独特的设计和精准的定位,在细分市场中占据一席之地。李翔还指出,独特性并非与生俱来就完美无缺,而是需要不断挖掘和培养。个人要持续学习、广泛探索,在实践中发现自己的兴趣和优势;企业要加大研发投入,鼓励创新,营造包容失败的文化氛围。

- 《控糖革命》读书笔记

在这个糖分泛滥的时代,血糖控制对于我们的健康至关重要。这本书就像是一本控糖的宝典,帮助我们更好地管理血糖,享受健康生活。不仅是一本控糖指南,更是一种健康生活方式的倡导。学会控糖,让我们远离血糖波动带来的困扰,迎接更加健康和活力的生活吧!快去阅读这本书,让你的健康掌握在自己手中!

- 《可能性的艺术》读书笔记

这本书从民主问责与国家能力双维度解析政治发展,涵盖全球化、政治转型、国家建构等五大主题。通过瑞典、丹麦等发达国家及南非、伊拉克等发展中国家的案例对比,揭示不同体制的治理逻辑与转型困境。书中将复杂政治理论转化为大众可理解的洞察,帮助读者以“抽离”视角理解社会现象,提供看待世界的全新尺度!

- 相似推荐

- 大纲

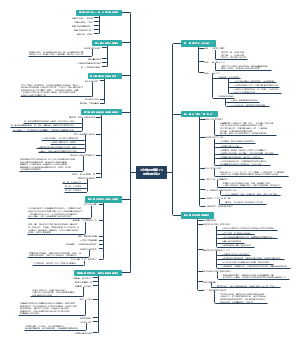

《投资中最简单的事》读书笔记

第五部分 投资心理学

人性的弱点:投资者常见的心理误区

家花不如野花香

对未来的成长抱有不切实际的过高期望,对现有的价值视而不见

过度自信

每个人都认为自己比平均水平强十倍

仓位思维

一旦重仓,对利好消息照单全收,对利空消息不以为然

锚固偏见

潜意识把原有股价当初合理、又参照性的锚点

短期趋势长期化

过度外推,把过去的增长过度外推到未来,把不可持续当做可持续

亏损厌恶症

股票的投资价值本应与买入成本无关,该不该卖与是否亏损无关

标题党

对新闻标题做出过度反应

榔头症

不同国家、不同行业,适用方法不同,但人们生搬硬套同种模式

在一个榔头看来,世界上所有东西都是钉子

选择性记忆

对持有的牛股津津乐道,对踩过的雷避而不谈

差点就赢

同样是错过航班,错过 3 分钟的比错过 30 分钟的更沮丧

羊群效应

基金经理抱团取暖,散户跟风炒作

心理账户

把钱分为本钱和原来的钱,且对两部分钱体现出不同的风险偏好

后视镜

投资者总是在“后视镜”中总结,希望在今年做去年做的事情

应该跑向球将要去的地方, 而不是球现在所在的地方

傻瓜定价说

股价能跌多深往往是由最恐慌的人决定的

聪明人的悲剧在于,往往低估了傻瓜傻的程度

这次不同了

人们从历史中学到的唯一教训就是人们从来不吸取任何教训

每一次危机或泡沫都像是史无前例的,其实不过都是历史长河中的一朵浪花

树动风动心动

短期股价波动:人心之间的博弈——心动(情绪面)

中期股价波动:政策暖风即上涨,政策寒风即下跌——风动(政策面)

长期股价波动:稳固根基的树不断成长——树动(基本面)

知易行难

市场持续不理性的时间可以长过你持续不破产的时间

第四部分 投资策略

四种周期、三种杠杆,行业轮动时机的把握

四种周期

政策周期领先市场周期

货币政策和财政政策放松,市场在资金面和政策面推动下重新估值

市场周期领先经济周期

美国历史上几乎每次经济衰退,股市都先于经济走出谷底

经济周期领先盈利周期

宏观基本面领先于微观基本面

熊末牛初,判断市场走势,资金面和政策面是领先指标,基本面是滞后指标

三种杠杆

第一阶段

财务杠杆:对利率的弹性

熊市见底,经济低迷,货币政策宽松,利率降低,财务杠杆高的企业先见底,如保险和证券

第二阶段

运营杠杆:对经济的弹性

经济复苏,利率稳定地位,运营杠杆高的行业领涨(销售收入小幅反弹带来利润大幅提升),如钢铁和航运

第三阶段

估值杠杆:对于剩余流动性的弹性

经济繁荣,利润快速增长,股价大涨,估值扩张,估值杠杆高、有想象空间的股票领涨,概念流行

第四阶段

熊牛替换,关注股票对正在改善的外部因素的弹性

周期分析:四个周期与三个杠杆的博弈

有周期就有可预测性

有杠杆,股价波动和基本面波动不成正比,股价反应要强烈的多

投资周期性股票,要在炮火声中买进,而在烟花声中卖出

熊市见底时,基本面总是不理想,这是黎明的黑暗

未来 10年:投资路在何方

未来十年要面对的问题

中国经济竞争力在削弱,经济增长速度放慢

能否跨越中等收入国家陷阱,要看供给层面的改善

执行城镇化策略

实现投资与消费的良性互动

促进城镇人口增长、人均资本增加、人均劳动生产率提高

未来十年的投资思路

从资产配置的角度来讲,股票比债券好

从商业模式看,高利润模式优于高周转模式,有定价权的公司好于有成本优势的公司

从投资风格上看,价值股好于成长股

对冲中国:机遇与挑战

海外市场对冲基金发展现状

对冲基金的第一个特点:收取业绩提成

对冲基金的第二个特点:必须对高净值客户,而不是普通大众

对冲基金并不是不承担风险,它只是对冲掉它不愿意承担的风险

中国发展对冲基金面临的挑战

工具不足,卖空不易

人才稀缺,合格的对冲基金经理少

环境、机构、氛围、渠道、客户

中国对冲基金发展的机遇和前景

需求大

放松市场管制和鼓励金融创新的大背景

世界金融市场的动荡

第三部分 投资风险

价值陷阱与成长陷阱

价值陷阱的共性:利润的不可持续性

价值投资最需要的是坚守,最害怕的是坚守了不该坚守的,关键在于避开价值陷阱

最容易陷入价值陷阱的股票

被技术进步淘汰的:数码相机发明后的以胶卷为主业的柯达

赢家通吃行业里的小公司:行业龙头在品牌、渠道、客户黏度、成本方面优势越来越明显

分散的、重资产的夕阳行业:行业需求不再增长,产能无法退出,无序竞争的价格战

景气顶点的周期股:顶峰利润不可持续)

有会计欺诈的公司

成长陷阱的共性:成长的不可持续性

高估值成长股平均回报不如低估值价值股,原因在于成长陷阱比价值陷阱更常见

最容易陷入价值陷阱的股票

估值过高:预期越高,失望越大

技术路径踏空:很难预见哪种技术胜出

无利润增长:客户黏度和转换成本低的B2C电商

成长性破产:现金流为负的成长企业,资金链断裂

盲目多元化

树大招风

新产品风险

寄生式增长:如为苹果间接提供零部件的公司,自身缺乏核心竞争力和议价权

强弩之末:对行业成长空间把握不当、对渗透率和饱和率跟踪不紧

会计造假

真假风险与安全边际

真假风险

成功的投资就是要承担那些已经暴露的、大家都感受到的、有相应风险折价但是真实危险性却很小的“假”风险

感受到的风险和真实的风险

股票暴涨后,真实风险上升,感受到的风险却在下降

股票暴跌后,真实风险下降,感受到的风险却在上升

暴露的风险和隐藏的风险

承担暴露风险:危险性已经反映在价格里了

避开隐藏风险

价格波动的风险和本金永久性丧失的风险

美国的VIX指数衡量市场的波动性,每次市场触底,都是VIX的高点

为什么大家更倾向于底部减仓

投资者承担股价波动风险能力弱,但其实底部时本金永久性丧失的风险已经非常低了

安全边际

东方不亮西方亮,给点阳光就灿烂

估值低到足以反应大多数可能的怀情况

有“冗余设计”,有“备用系统”来限制下跌空间

价值易估,不具反身性,可越跌越买

止损

价值投资者卖股票只有三个情况:基本面恶化,价格达到目标价,有更好投资选择

不止损的前提

避开价值陷阱

有足够安全边际

承担的只是价格波动风险而非本金丧失风险

价值投资的局限性

价值投资的适用条件

所买的公司的内在价值应该是相对容易确定的

所投资的公司的内在价值应该相对独立于股票价格

不具有反身性

要在合适的市场阶段采用

牛市的前半段

选取合适的投资期限

价值投资适合长线投资

趋势投资适合中短线投资

书籍信息

作者: 邱国鹭

高毅资产董事长兼CEO,具有20年基金业投资管理经验

曾获评《中国基金报》英华奖之“中国基金业20年最佳基金经理”等多个奖项

出版社: 中国经济出版社

出版年: 2020-3

相关书籍推荐

《价值:我对投资的思考》

《时间投资法》

第一部分 投资理念

以实业的眼光做投资

这是不是一门好生意

2013年火爆的手机游戏行业,实际上是一门烂生意

手机游戏数量多,做好的少,生命周期短,用户黏度低,利润都被平台赚走了

现在再看呢

企业的商业模式和现金流状况

2013年受市场热捧的电影行业现金流状况很差

票房不可预期,前期投入多,净利润少,资金预支,现金流差,不确定性高

相比而言

房地产的商业模式好

利润高,拍电影不是每部都能火,别墅却几乎栋栋卖得掉

现金流要求低

出钱拍地挖坑做沙盘就能预售,拿钱盖房子

所以好公司有两个标准

第一是他做的事情,别人做不了

第二是他做的事情,自己可以重复做

行业的竞争格局和公司的比较优势

互联网金融和传统银行:未能颠覆

互联网的本质是“人生人”,典型的散户经济

银行业的本质是“钱生钱”,二八现象明显,得大户者的天下

网络银行不会因为用户多而形成网络效应或提升用户体验,优势并不明显

线下银行业集中,五大行和上市股份制银行的市场份额、资本实力、品牌认知和网点优势都很明显

寡头的力量

垄断行业,利润一直都是超出预期的,而市场集中度低的行业才会陷入恶性竞争

同样是家电,白色家电(空调冰箱洗衣机)就是寡头垄断,而黑色家电(电视)集中度越来越低

人弃我取,逆向投资的关键

逆向投资的关键

卡尔·伊坎:买别人不买的东西,在没人买的时候买

巴菲特:别人恐惧时我贪婪,别人贪婪时我恐惧

一直下跌的股票是否值得逆向投资

估值是否够低、是否已经过度反映了可能的坏消息

遭遇的问题是否是短期问题。是否是可解决的问题

股价暴跌本身是否会导致公司的基本面进一步恶化,即是否有索罗斯所说的反身性

不是每个行业都适合做逆向投资

有色煤炭最好跟着趋势走

钢铁之类的夕阳行业可能是价值陷阱

计算机、通讯、电子等技术变化快的行业不适合越跌越买

食品饮料是适合逆向投资的领域

食品安全事故往往是行业投资较好的买入点

要注意几个问题

有没有替代品,替代品太多应谨慎

行业问题还是个股问题

品牌价值

最一致的时候就是最危险的时候

作为投资者要做的就是清楚分辨市场的错误定价在哪个版块以及错误的程度有多大,然后远离被高估的板块, 买入被低估的公司

逆向投资并非一味地与市场作对,因为市场大多时候是对的

但有的时候市场也可以错的离谱,此时就不必在意市场的主流观点了

逆向投资,未来超额收益的重要源泉

逆向投资者的必备素质:买早了还得熬得住

市场中没有人能够卖在最高点,买在最低点

便宜才是硬道理

价格本质上是一种货币现象

投资中影响股价涨跌的最重要因素:估值 和 流动性

估值决定了股票能够上涨的空间,流动性决定了股市涨跌的时间

买的时候足够便宜,就不用担心做傻瓜

要牢牢抓住定价权

选股票,一定是先选行业,选择有门槛、有积累、有定价权的行业

高门槛行业,新进入者难存活,因此行业供给受限,竞争有序,有利于企业盈利增长

门槛,即是行业护城河

三个层次的悲观

基于流动性和供求关系的悲观

对基本面的悲观

对中国经济增长模式的悲观

第二部分 投资方法

投资的三个基本问题

为什么认为一家公司便宜(估值)

世界上不存在每年都有效的投资方法。如果一种方式稳赚不赔,就会被套利掉

投资分析的基本工具

波特五力:重点在于议价权、比较优势和门槛

杜邦分析:高利润,高周转,还是高杠杆

估值分析:同业横比和历史纵比

股票的回报不取决于未来增长的快慢,取决于未来增长比当前股价反映的增长预期更快or更慢

不要为普通公司付太贵的价钱

为什么认为一家公司好(品质)

品质的判断1:是不是一个好行业

公司品质的好坏,在于能不能具有定价权

进一步取决于行业格局是否良性、行业竞争是否激烈

政府扶持的新兴行业,务必谨慎,如风电、光伏,增加供应

产能过剩和恶性竞争

品质的判断2:差异化竞争

品牌:知名度和美誉度并重

用户黏性高

单价不要太高:容易有定价权

转换成本:转换成本高的产品用户黏性高,定价权就高

服务网络:龙头企业在服务布点上的优势让后来者很难追赶

先发优势:注重有先发优势的龙头

为什么要现在买(时机)

这是一个世界难题,基本接近艺术,只能悟道,不能学习

短期选时难度大,长期择时更有意义

看估值

根据各种指标之间领先和滞后关系进行分析

对市场情绪的把握和逆向思考的分析

宁数月亮,不数星星

数月亮

集中度高,两三个龙头,竞争有序,赚钱不辛苦

数星星

集中度低,行业门槛低,竞争激烈,辛苦不挣钱

行业竞争格局由好到差

月朗星稀

一超多强

两分天下

三足鼎立

百花齐放

数月亮的行业其实就是寡头垄断行业,这样的行业不多,但在细分子行业层面或者区域市场上也不少

国家给的寡头垄断不算,因为有价格管制,要看市场竞争、行业洗牌后留下的寡头垄断

经验就像旧衣服

选股有两个最好的指标:ROIC和EV/EBIT

资本回报率ROIC:税后收入/所有者权益

衡量资金使用效率,反映了资金成本

企业估值倍数(EV/EBIT):企业价值/税前利润

一般用于市盈率比较高的股票身上,让它显得不是那么昂贵

适用于制造业和各种周期行业

衡量企业现金流,能筛选高杠杆的公司

对金融股没有意义