导图社区 猪和牛的行为识别

- 94

- 0

- 0

- 举报

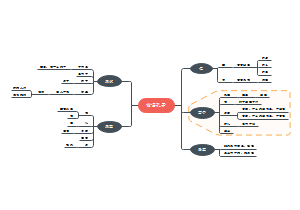

猪和牛的行为识别

猪和牛的行为识别,包括身体的整体分割、身体部分分割、从身体部位到整体的猪的识别、从身体部位到整体的牛的识别、饮水行为等内容。

编辑于2021-12-29 18:31:21- 猪只 机器…

- 相似推荐

- 大纲

猪和牛的行为识别

图像分割

身体的整体分割

单母猪整体分割

2013,Tu

使用的方法

使用纹理整合更新背景建模作为参考图像,然后在当前图像和通过小波变换得到的当前参考图像之间进行减法。

最后,根据伪小波系数对像素和它的邻居之间的配对关系进行建模,并通过使用循环信念传播来逼近图像概率。

研究目的

这项研究显示了如何在复杂的产房场景中提取前景猪,例如,突然的光线变化、动态背景和不动的前景物体。

为了分割产房中的母猪及其仔猪

2014,Khor- amshahi

使用方法

基于一个点周围的小邻居定义了一些图像局部特征,并比较了它们的可分离性和性能指标。

最后,使用前馈神经网络(NN)对母猪和背景之间的像素进行分类,并在可接受的准确度和计算时间方面选择了一个实际的配置。

研究目的

这项研究证明了在缺乏背景信息的情况下提取前景的可能性。

为了在白天和晚上对产房中的单身母猪进行分割(图1(b))

计算机视觉方法

2018,Yang

使用方法

通过使用全卷积网络(FCN)对母猪进行分割,并通过使用以下方法完善FCN的粗略输出从FCN的最后一层的概率图和大津的阈值。从色相、饱和度和价值的颜色信息中得出结论。

这种深度学习方法与Simul-taneousDetectionandSegmentation(SDS)、Otsu、MixtureofGaussians(MoG)和传统的FCNs相比,提高了分割结果。

研究目的

为了进一步将单身母猪从散养猪群中分离出来(图1(c)),

深度学习

为了提取群居环境中的猪

2014,Guo

使用方法

通过使用基于预测机制的高斯混合体(PM-MoG)检测前景猪并根据前景物体的颜色信息,采用最大熵分割法。

最后,将前两步的前景检测结果进行融合。这种方法可以在复杂的场景中提取相对完整的前景猪,例如,光线的变化、地面尿渍、水渍、粪便的影响和其他杂物,猪的缓慢运动模式,以及不同颜色的猪。

研究目的

为了提取群居环境中的猪

2015,Guo

使用方法

用最大熵全局阈值从经直方图均衡化增强的图像中分割猪。

然后,从最初分割的物体中计算出每个物体的中心点,并将原始图像自适应地分成多个圆形子块,其原点是中心点,半径是中心点到边缘点的最大距离。

最后,在每个子块中使用多级阈值分割法获得准确的二次分割结果。

研究目的

为了提取群居环境中的猪

存在问题

然而,当猪相互接触时,上述两种方法将是无用的。

2016,Lu

使用方法

椭圆拟合被用于大量有一只猪的图像。提取了不同年龄段的单只小猪的图像所拟合的椭圆参数范围。

其次,对不同年龄段的单体猪图像进行椭圆拟合。 提取了触摸猪图像中的成分。每个轮廓都是 基于凹陷点进行分割。对每个等高线段进行椭圆拟合。

最后,提出了5条椭圆合并规则,用于合并异常的椭圆。椭圆合并后,椭圆的数量与猪的数量相等。

研究目的

解决猪只互相接触方时候,检测效率下降的情况

存在的问题

然而,当猪的数量超过7头时,这种算法的准确性可能会降低

2019,Li

使用方法

开发了一种基于多特征模板匹配的猪检测方法(图1(g))。

首先,两个互补的描述符,即主导方向模板(DOTs)和亮度比模板(BRTs),被结合起来表示图像。主导方向模板建立了与边缘特征的关系,而亮度比模板编码了强度和纹理特征。这两个描述符都是以二进制形式给出的,以提高算法的时间效率。然后,通过一个基于模板聚类的自动选择过程,可以从训练图像中获得有代表性的猪模板。最后,对输入图像进行扫描,计算出所有模板的匹配响应。因此,与给定模板具有相似视觉特性的物体被认为是检测到的猪。

研究目的

解决猪只互相接触方时候,检测效率下降的情况

这项研究可以在包括多个干扰源的复杂场景中有效、可靠地提取猪,例如,不均匀的光照、不同颜色的前景物体、缓慢移动的猪等等。上述多猪分割的方法属于计算机视觉。由于深度学习方法可以对猪进行分割,具有良好的每 在猪的接触、重叠和咬合的条件下,形成了一个很好的效果。 不同的视角等,

2018,Brünger

使用方法

介绍了一种适应猪的椭圆的方法,它不是基于分割的边缘,而是着眼于所有分割的像素(图1(h))。

研究目的

这使得它更容易补偿分割中的小错误,并有助于处理图像,即使在次优条件下,如光线不足或不利的相机位置。

Zhang等人(2019a)

使用方法

用单次多箱检测器(SSD)架构与修改后的损失函数作为检测器来分割猪,并比较了基于区域的卷积神经网络(Faster R-CNN)、基于区域的全卷积网络(RFCN)和SSD的猪检测(图1(i))。

首先,基于CNN的特征提取,该方法采用骨干架构,具有深度为101层的残差网络(ResNet-101)和特征金字塔网络(FPN),可以根据不同尺度从特征金字塔的低层和高层提取特征。然后,根据从骨干结构中提取的特征,通过区域提议网络(RPN)生成候选感兴趣区域(RoI)。最后,检测并分割出每个感兴趣区域的猪。这种方法可以稳健地检测和分割多头猪。 群体饲养的猪的自然场景,例如,不均匀的光照,猪的视线,猪的身体。 融合和重叠。

研究目的

这项研究可以在光线波动、猪的相似外观、形状变形和遮挡等条件下检测猪,并且可以在白天和红外(夜间)光线条件下跟踪猪。Tu等人(2020年)开发了一种基于掩码评分的R-CNN框架的分割方法,以解决猪的前视和俯视分割(图1(j))。

对于多头牛的身体整体分割

Qiao等人(2019a)

方法

开发了一种基于Mask R-CNN深度学习框架的分割方法,

该方法包括4个步骤,即用于检测巨大牛群运动帧的关键帧提取,用于减少光照和阴影影响的图像增强,牛群分割,以及身体轮廓提取

目的

以解决真实饲养场环境中的牛群分割和轮廓提取问题

这项研究可以提供相当理想的牛群分割性能,平均像素准确度(MPA)为0.92,实现轮廓提取的平均距离误差(ADE)为 33.56像素,优于最先进的Sharp- Mask和DeepMask分割方法。

Xu等人(2020年)

方法

应用Mask R-CNN的前沿实例分割框架对四旋翼飞机获取的牛图像进行分割,并对不同情况下的牛进行计数,如广泛的生产性牧场,也包括饲养场等密集的住房(图1(l))。

目的

通过性能评估验证了本研究中算法的最佳IoU阈值和全貌检测。 该研究表明 框架的潜力,在离线四旋翼视觉系统中可靠地执行对牧场和饲养场中的牛的计数。

与之相比 在现有的典型竞争算法中,Mask R-CNN在计数精度和平均精度上都优于其他算法,特别是在有遮挡和重叠的数据集上。的性能上

身体部分分割

Jia等人(2021年)提出了一种计算机视觉方法,通过使用改进版的模板匹配,自动分割牛的九个身体部位,即头部、躯干、乳房、腹部(或后部)、左前腿、右前腿、左后腿、右后腿和尾部(图1(m))。结果表明,从RGB深度图像中自动检测和提取身体部位是可能的,不需要任何人工干预。

Psota等人(2019年)开发了一种用于群居环境中多头猪的实例级检测的算法(图1(n))。该方法使用单一的完全卷积神经网络来检测左耳、右耳、肩膀和尾巴的位置以及每头猪的方向,其中身体部位的位置和成对的关联都在图像空间中表示。为了克服传统物体检测算法无法高精度检测奶牛关键部位的困难

,Jiang等人(2019)测试了基于FilterLayer的深度学习网络FLYOLOv3(FilterLayer YOLOv3)来检测复杂场景中奶牛的关键部位(即头、躯干和腿)(图1(o))。由于图像在训练过程和初始化过程中是不稳定的,卷积后的特征图中会产生粒子噪声。因此,进行了平均滤波算法,并使用泄漏整流函数(Leaky ReLU)来整合定制的FilterLayer层以减少训练干扰。首先使用人工注释来标记图像中牛的头部、躯干和腿部的边界,然后用标记的样本训练FLYOLOv3网络。最后,训练好的模型被用来测试图像。该方法与Faster R-CNN和YOLOv3算法通过指标进行了比较,如准确率、召回率、平均帧率和平均准确率。

Liu等人(2020a)设计了一个侧视奶牛结构模型来描述奶牛的关节(关键点)的空间位置,并开发了一个使用深度学习从视频中自动提取结构模型的系统(图1(p))。该系统可以检测同一帧中的多头奶牛,并在障碍物(栅栏)和光照不足等实际挑战下为身体区域提供稳健的性能。

识别

发展和变化

从群体行为识别到个体行为识别

从身体部位到整体的猪的识别

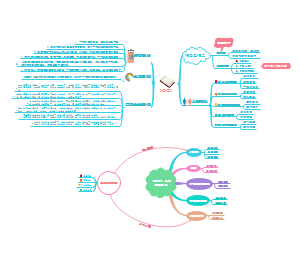

Ahrendt等人(2011年)开发了一个实时计算机视觉系统,用于识别和跟踪散养马厩中的猪(图2(a))。追踪算法分两步操作。第一步是建立支持图,指向每一帧视频中的初步猪段。在第二步中,支持图段被用来建立单个猪的5D-高斯模型(即位置和形状)。该系统对来自摄像机镜头的鱼眼畸变进行了软件校正。鱼眼镜头使摄像机能够监测马厩中更大的区域。在现实的实验中,该系统至少可以跟踪3头猪超过8分钟,而不会失去对单个猪的跟踪和识别。然而,这项研究需要在猪的背部区域进行人工标记。

为了实现无需人工标记的猪识别,Hansen等人(2018)在农场环境中捕获了猪脸图像,并使用人工增强的数据集训练了一个CNN模型(图2(b))。使用Grad-CAM的类激活映射被用来显示网络用来区分猪的区域。这项研究进一步比较了所提出的CNN模型与Fisherfaces和VGG-Face预训练的人脸CNN模型,后者是在人脸识别中采用的技术。

Marsot等人(2020)通过两个基于Haar特征的级联分类器和一个浅层卷积神经网络来进一步检测猪的面部和眼睛,以获得额外的高质量图像(图2(c))。通过使用深度卷积神经网络进行脸部识别,并利用grad-CAM生成的类激活图和显著性图来直观地了解神经网络是如何学习鉴别参数的。这项研究的结果将促进基于人工智能的动物识别在猪生产中的实际应用。然而,这些基于猪脸的识别方法需要猪合作进入指定区域,以获得猪脸的图像,这可能涉及人类的干预。 为了实现无需人工干预的猪的识别,猪身上用于识别的区域已经从身体部位转移到身体整体。

Zhu等人(2017)提取了饮水猪的色矩、面积、周长等特征,并通过计算猪与标准样本的欧氏距离来识别个体猪。

Huang等人(2018)通过用Gabor滤波器对猪图像进行卷积提取Gabor特征,并通过使用局部二进制模式(LBP)提取局部结构特征(图2(d))。然后使用主成分分析(PCA)来减少特征维度,并将这些特征串联起来形成特征向量。最后,支持向量机(SVM)被用来对这些特征向量进行分类,以识别站立的猪。

Huang等人(2020)提出了一个Weber纹理局部描述器(WTLD),通过提取背毛、皮肤纹理和斑点的局部特征来识别猪(图2(e))。通过计算像素的差分激发和多方向入射,融合主方向的局部结构特征,增强了特征的描述能力。结果表明,WTLD在较低的特征维度下取得了较高的识别率。该方法可以识别猪圈中不同位置和姿态的猪个体。然而,上述用于识别猪的计算机视觉方法主要适用于较为松散的围栏。

为了进一步识别触摸的猪,Yang等人。 (2018b)使用Faster R-CNN来定位和识别群居猪圈中的单个猪(图2(f))。每头猪的头部也被定位。设计了一种将每头猪的头部与身体联系起来的算法。

从身体部位到整体的牛的识别

Allen等人(2008)记录了牛的独特视网膜 牛眼后部的血管图案(RVP),并与RVP相匹配。 通过Optibrand Matching Engine(图2(g))对同一动物的相同眼睛进行识别。

Lu等人(2014)开发了一个基于虹膜分析的奶牛识别系统,其中包括虹膜成像、虹膜检测和识别(图2(h))。首先,评估拍摄序列的图像质量,并选择清晰的虹膜图像进行后续处理。其次,在分割过程中,根据边缘图像,将奶牛虹膜的内部和外部边界分别拟合为两个椭圆。然后得到分割后的牛虹膜,并使用几何方法进行归一化处理。最后,使用二维复杂小波变换(2D-CTW)来提取奶牛虹膜的局部和全局特征,并将过滤后的奶牛虹膜的相位编码为特征,以匹配奶牛的身份。

Gaber 等人(2016年)使用韦伯局部描述符(WLD)从牛嘴印图像中提取稳健特征(图2(i))。然后用AdaBoost分类器从牛的WLD特征中识别牛的头部。

与K-NN和Fk-NN算法相比,这种WLD和AdaBoost算法的结果很好。在上述研究中,用于识别的身体部位主要集中在 在牛的视网膜、眼睛或鼻子上。这需要这些身体部位被 在受约束的环境中。

为了识别非约束环境中的牛,Li等人(2017)将尾巴头图像作为感兴趣区域(ROI),然后用Zernike矩作为ROI上白色图案的形状特征描述符(图2(j))。

从预处理的图像中提取了两组Zernike矩,并使用四种备选分类器进行分类,即线性判别分析(LDA)、二次判别分析(QDA)、人工神经网络(ANN)和SVM。这些结果表明,低阶Zernike矩值特征以及QDA和SVM算法是识别个体乳牛的有效方法,并且具有在精准动物管理中的重要应用。

Zhao等人(2019)开发了一个计算机视觉系统,在乳牛直线行走的侧视视频中提取身体图像并识别荷斯坦奶牛(图2(k))。使用自适应SOM方法检测奶牛面具。提取最大的内切矩形来定位牛的位置。 牛的身体区域。身体图像的特征点被提取出来,并且 与模板数据集相匹配以识别未知的奶牛。对四种特征提取方法和两种匹配方法进行了调查和评估。结果显示,当使用加速片段测试(FAST)、尺度不变特征转换(SIFT)和FLANN方法进行特征提取、描述符和匹配时,识别精度最高。然而,在高精确度的基础上,定向FAST和旋转BRIEF(ORB)以及BruteForce的组合具有更好的计算效率。

机器视觉方法

Kumar等人(2018)开发了一种基于深度学习的方法,用于根据牛的口鼻点图像模式识别个体牛(图2(l))。基于深度学习的卷积神经网络(CNN)和深度信念网络(DBN)方法被用来提取突出的纹理特征集,并代表牛的枪口点图像。叠加去噪自动编码器(SDAE)被用来对提取的枪口点图像的特征进行编码。这种深度学习方法在识别牛的枪口点图像数据库中的表现优于最先进的方法。

Sun等人(2019年)利用深度学习框架开发了一个自动系统,用于识别个体牛并评估身体状况评分(BCS)(图2(m))。这 工作开发了一个使用超声的BCS线性回归模型 训练集的背膘厚度来确定BCS,并测试了一个基于卷积神经网络的系统,有3个通道,包括深度、灰度和相位一致性。

Hu等人(2020)开发了一种基于深部特征融合的奶牛识别方法(图2(n))。首先,拍摄了一组奶牛的侧视图像,然后应用YOLO物体检测模型定位每张原始图像中的奶牛物体,然后通过使用帧差和分割跨度分析的部分分割算法将其分为三个部分,即头部、躯干和腿部。然后,训练三个独立的卷积神经网络(CNN)从这三部分提取深层特征,并设计了一个特征融合策略来融合这些特征,即深层部分特征融合。最后,使用由融合特征训练的支持向量机(SVM)分类器来识别每一头奶牛。在上述研究中,可以看出,基于身体部位的牛群识别已经从计算机视觉发展到了深度学习。

此外,还出现了基于身体整体性的牛群识别研究。Okura等人(2019年)开发了一种基于三维视频分析的奶牛识别方法,该方法使用RGB-D相机,捕获带有RGB颜色信息和主体距离相机的图像。利用行走中的奶牛的RGB-D视频,开发了一个统一的方法,使用两个互补的特征进行识别,即步态(即行走风格)和纹理(即标记)(图2(o))。

Qiao等人(2019b)开发了一个基于深度学习的框架,利用图像序列识别肉牛,统一了CNN(卷积神经网络)和LSTM(长短时记忆)网络方法的优点(图2(p))。一个CNN网络(即InceptionV3)被用来从后视牛的视频数据集中提取特征,然后用这些提取的特征来训练一个LSTM模型,以捕捉时间信息并识别每个动物个体。

深度学习

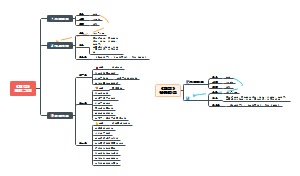

行为识别

攻击行为

Viazzi等人(2014a)使用了运动历史图像(MHI)。 提取猪群移动像素的数量作为平均运动强度,并提取移动像素与猪群像素的比率作为占用指数(图3(a))。基于这两个特征,线性判别分析(LDA)被用来识别猪的攻击性行为。

Oczak等人(2014)提取了 训练了一个多层前馈神经网络,并计算了活动指数的平均值、最大值、最小值、总和和方差作为特征。训练并验证了一个多层前馈神经网络,对高攻击性和中等攻击性的事件进行分类。

Lee等人(2016)使用Kinect 深度传感器来提取速度的最小、最大、平均、标准偏差和站立猪之间的距离作为特征向量(图3(b))。用两个二元分类器SVM以分层的方式对这些特征向量进行分类,以识别猪的攻击行为。然而,猪群或站立的猪包括移动但无攻击性的猪,因此从这些猪身上提取的特征会影响攻击性识别的准确性。为了进一步将成对的攻击性猪从猪群中分离出来,

Chen 等人(2017)根据攻击过程中连续和大比例粘连的特点,利用连接面积和粘连指数跟踪2头攻击性猪,然后将这2头猪视为整个矩形,提取这个矩形的加速度特征(图3(c))。基于这一特征,设计了攻击性识别规则,以识别中度和高度攻击性。

为了进一步从上述矩形中找到猪身上的运动特征,Chen等人(2018)通过对这2头攻击性猪的运动分析,在猪的轮廓上找到5个特征点并计算出动能差作为特征(图3(d))。采用层次聚类法对这些特征进行分类,得到高、中度攻击性的阈值。基于这些阈值,设计了攻击性识别规则,以识别每个最小识别单元(MRU)的中度和高度攻击性

为了通过设置帧与帧之间的距离来减少算法的计算量,Chen等人(2019)设置了帧与帧之间的距离并使用帧差法来获得移动像素。然后,通过设置连接区域的阈值,去除由非攻击性行为引起的移动像素(图3(e))。将过滤后的移动像素数相加,定义为每一帧的运动形状指数(MSI)。在将所有视频划分为3个s单元后,提取每个单元中MSI的最大值、平均值、方差和标准差作为特征。最后,支持向量机(SVM)被用来对这些特征进行分类以识别攻击行为。

上述研究的重点是对空间特征的提取每一帧中的猪。为了直接利用每一集的空间-时间特征来识别攻击行为,Chen等人(2020a)开发了一种基于卷积神经网络(CNN)的深度学习方法 和长短期记忆(LSTM)来识别猪的攻击性事件(图3(f))。首先,CNN架构VGG16被用来提取空间特征。然后,这些特征被输入到LSTM框架中,以便提取空间-时间特征。通过全连接层, 预测函数Softmax最后被用来确定当前情节是攻击性还是非攻击性。这项研究通过改变情节长度和帧率进一步提高了攻击性识别的准确性。

饮水行为

为了识别产房内单只猪的饮水,Lao等人研究了猪的饮水。C.Chen et al. (2016)在深度图像中定位了母猪的头部,然后根据头部和饮水器之间的距离来识别母猪在站立和坐姿下的饮水情况(图4(a))。

Leonard等人(2019年) 也研究了这种情况,并开发了一种方法来检测饮水器附近是否有母猪的鼻子。他们首先量化了靠近饮水者的规定区域内的像素数,当该区域内的 "鼻子 "像素数大于阈值时,饮水事件被分类。在这两种情况下,饮酒行为都是 当猪处于饮水器周围的有限空间环境中时,通过猪鼻子和饮水器之间的简单位置关系进行检测(图4(b))。

为了进一步识别无限空间内单只猪的饮水,Yang等人(2020)首先将母猪从包括母猪及其仔猪在内的猪群中区分出来,然后使用完全卷积网络(FCN)提取猪鼻到饮水乳头的距离和头部圆度作为空间特征,以区分头上/头下。他们进一步使用光流向量将头部的运动强度定义为时间特征,并在最后的识别算法中结合了空间和时间特征(图4(c))。从上述研究可以发现,单猪饮酒识别已经从计算机视觉发展到深度学习。

为了实现多头猪的饮水识别,Kashiha等人(2013)利用猪体的中心点和轮廓线之间的距离来定位猪的鼻子相对于它的身体。当这个距离 鼻子和饮水器之间的距离小于10像素,并且访问饮水器的时间超过2秒,则该猪被归类为饮水,并估算出耗水量(图4(d))。

Zhu等人(2017)提取了猪在饮水区域的颜色时刻、面积和周长作为特征向量,然后计算这些向量与标准饮水模板之间的欧氏距离。这 距离和持续时间被用来识别猪的存在以对是否发生饮水进行分类(图4(e))。

Zhang等人(2019b)提出了一种基于深度学习的母猪行为检测算法(SBDA-DL),通过使用MobileNet 分类网络的深度可分离卷积操作。该算法基于四头母猪的数据进行训练,以检测其饮水、排尿和骑乘行为(图4(f))。在上述研究中,多头猪饮水识别主要涉及空间特征。然而,仅使用从图像帧中提取的空间特征并不容易区分饮水和玩耍,因为在饮水或玩耍的过程中,从猪鼻到饮水者的距离都很近。

为了进一步对视频中猪的饮水和耍酒疯的情况进行分类 节目中,Chen等人(2020b)通过以下方法提取了空间-时间特征 使用CNN架构ResNet50和LSTM来确定当前情节是饮酒还是喝酒(图4(g))。在这项研究中,将饮酒感兴趣的区域从身体区域缩短到头部区域可以提高分类的准确性。

进食行为识别

猪的

目前关于猪采食行为识别的文献表明,研究主要集中在母猪个体或群体层面。

对于个体母猪,Lao等人(2016)开发了一种用深度传感器检测采食行为的方法。该算法首先获得了身体部位和喂食器的坐标,当发现头部的高度低于喂食器的高度,并且头部和肩部之间的距离小于站立的母猪的距离时,该母猪被认定为正在进食(图5(a))。

Leonard 等人(2019)开发了一种不同的基于深度传感器的图像处理方法。根据在喂食器周围预先确定的区域内捕获的母猪头部面积来确定喂食母猪的方法。在上述两项研究中,母猪都被限制在产房内,其中 头部和喂食器之间的空间关系足够小,可以识别单头母猪的喂食(图5(b))。由于散养母猪在群体中的行为不可能受到空间的限制,上述方法的识别精度可能会降低。

为了克服这个问题,Yang等人(2020)首先将母猪从包括母猪及其仔猪的猪群中区分出来,然后用全卷积网络(FCN)提取头部的圆度和头部与采食区的重叠区域作为空间特征。他们进一步利用光流向量将头部的运动强度定义为时间特征,并在最终的检测算法中结合空间和时间特征(图5(c))。

对于多头猪的采食识别,Yang等人(2018b)使用快速区域卷积神经网络(Faster R-CNN)来识别4头母猪的身份,并提取占用指数(即头部与采食区域的比率)作为空间特征来识别每头猪的采食行为(图5(d))。

Alameer等人(2020)开发了一个基于GoogLeNet的深度学习方法用于饲喂检测,该方法不依赖猪的跟踪,能够区分一群猪的饲喂和非营养性访问(NNV)(图5(e))。

Chen et al. (2020c)通过使用CNN进一步提取了空间-时间特征。 架构Xception和LSTM来识别猪在群体水平上的采食行为。为了将识别结果从群体水平转换到个体水平,提出了一种基于最大熵分割、HSV(色相、饱和度和数值)色彩空间转换和模板匹配的图像处理算法,计算出猪头的圆度、猪头与采食子区域的比例、猪头运动的累计像素以及猪头到猪背上数字的距离,以确定每头猪的身份和采食时间(图5(f))。从上述研究中可以发现,无论是单头猪还是多头猪的采食识别都已经从计算机视觉发展到深度学习。

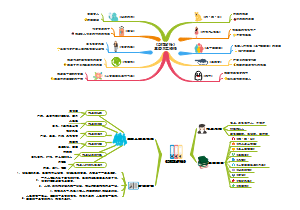

牛的

Porto等人(2015)通过定义一种基于Violae-Jones算法的方法,并使用多摄像头来识别奶牛的采食和站立行为。通过视频记录系统,以获得牛舍某个区域的全景顶视图像(图5(g))。在这些研究成果的基础上,拟议的系统适合计算奶牛行为指数和 对行为变化的实时检测。

Achour等人(2020年)将乳牛的头顶图像作为感兴趣区域(ROI),并使用基于卷积神经网络的不同分类器 (CNN)模型来识别采食行为,并对17头荷斯坦乳牛进行个体识别(图5(h))。

Bezen等人(2020年)设计了一个计算机视觉系统,用于测量奶牛个体的采食量,该系统基于深度卷积神经网络(CNN)模型和低成本的RGB-D(红、绿、蓝、深)相机(图5(i))。通过结合RGB和深度图像的信息来估计饲料摄入量。使用RGB图像进行奶牛识别。使用CNN模型开发了用于识别和摄入量估计的深度学习算法。训练分析表明,基于RGB-D数据的模型比基于无RGB的深度通道数据的模型显示出更好的结果。

跛足行为

最初,Song等人(2008)提取了定义为 "后部 "的足迹。利用计算机视觉技术,经过背景减法、二元图像运算、校准和蹄部分离后,对牛的运动进行评分,以估算出 "牛蹄与前蹄位置的比较"。 牛群中的跛行情况(图6(a))。

Poursaberi等人(2010)提出了一个层次背景/前景夸张法来分割每一帧中的奶牛并在视频中跟踪它。对数和指数的组合、背景减法以及统计滤波被用来寻找奶牛的准确形状。此外,每头牛在站立和行走时的背部姿势被自动提取。这是通过检测背部姿势的弧度和通过脊柱线上的选定点拟合一个圆来完成的。显示后蹄与地面接触的四帧的平均反半径(一排中每个蹄子有两帧)被分配给奶牛。根据这个曲率值,自动给出代表个体奶牛跛行状态的分数(图6(b))。上述研究将阈值应用于整个群体,以检测个体奶牛是否跛行。

Viazzi等人(2013)进一步开发了个体化版本的身体运动模式评分,利用背部姿势将跛行分为3个等级,并在农场条件下对群体和个体方法进行了比较(图6(c))。在上述研究中,二维摄像机在侧视图中定位,用于测量背部姿势。然而,这种方法在农场条件下并不总是适用,因为它可能难以安装。阴影和背部地面的连续变化也使图像分割变得困难,而且经常出现错误。

为了克服这些问题,Viazzi等人(2014b)提出了一种新的计算机视觉方法,通过使用俯视视角的三维摄像机来提取步行牛的背部姿势(图6(d))。结果表明,三维摄像头的应用带来了与侧视法相当的精度,而且顶视法可以克服自动化和处理时间方面的限制。

Hertem等人(2014)优化了基于计算机视觉的算法的分类输出,用于自动跛行评分。使用3D相机进行的现场评估的5分运动评分是自动跛行评分的参考。使用奶牛个体连续测量提高了自动跛行检测系统的正确分类率。

Zhao等(2018)利用计算机视觉技术分析了腿部摆动,开发了一个自动连续的奶牛运动评分系统,以检测和预测跛行,具有较高的准确性和实用性(图6(e))。通过图像处理提取运动腿的位置,绘制出运动曲线,并对运动曲线进行分析,生成六个特征,分别指步态不对称、速度、跟踪上升、站立时间、步长和柔弱程度。3类特征的箱形图显示,在6个特征下,数据集几乎是线性的、可分离的,奶牛在不同的跛足阶段有不同的跛足指标。

计算机视觉

Wu等人(2020)提出了一种基于YOLOv3深度学习的方法学习算法和相对步长特征矢量对瘸腿牛和非瘸腿牛进行分类(图6(f))。视频被分解成序列帧,每一帧中的奶牛腿部目标由以下方法检测 YOLOv3算法。牛的前腿和后腿的相对步幅是 根据腿部坐标计算,并构建了相对步长的特征向量。最后,使用经过训练的长短时记忆(LSTM)分类模型,根据特征向量对瘸腿牛和非瘸腿牛进行分类。使用LSTM、支持向量机(SVM)、K-近邻(KNN)和决策树分类器(DTC)算法共选择了210个视频进行验证。结果显示,基于LSTM的跛行检测准确率为98.57% ,比SVM 、KNN 和DTC 分别高2.93%、3.88%和9.25%。由于典型的奶牛跛行动作只有几秒钟的时间,并表现出特有的时空结构

Jiang等人(2020年)试图捕捉这种结构,并用卷积神经网络学习动作表征(图6(g))。然而,这种表征通常是在几个视频帧的水平上学习的,因此不能对动作的整个时间范围进行建模。在这项研究中,他们使用单流长期光流卷积的神经网络学习视频表征。实验结果表明,单流长期光流卷积网络模型增加了时间范围,提高了乳牛跛行动作识别的准确性。

深度学习

爬胯行为识别

最初,Nasirahmadi等人(2016年)开发了一种方法,用于自动检测商业化猪群中的装载事件。 通过图像处理(图7(a)),对农场条件进行了分析。椭圆拟合技术被应用于图像中猪的定位。每个拟合椭圆的主轴和小轴之间的截面点以及椭圆形状被用来定义每头猪的头、尾和侧面。头部和尾部、头部和侧面之间的欧几里得距离,以及爬胯过程中拟合椭圆的主轴和小轴长度被用于开发自动识别爬胯事件的算法。

Guo等人(2019)提出了一种利用在奶牛场拍摄的视频中识别的图像区域的几何和光流特征来检测奶牛的骑乘行为的方法(图7(b))。首先,使用遮蔽技术去除未被识别的背景,将RGB 颜色空间转换为HSV颜色空间,并调整HSV通道的求和系数,以改善奶牛和背景图像之间的对比度。随后,提出的带有颜色和纹理特征的背景减法(BSCTF)算法被用来检测奶牛区域。然后,为了对检测区域进行帧间差分处理,提取了区域的几何和光流特征,并使用七个优化的特征来构建区域特征向量。最后,训练了一个支持向量机(SVM)分类器,将检测到的区域划分为骑乘区域和非骑乘区域,从而可以识别骑乘行为。在上述研究中,计算机视觉技术被用来识别猪和牛的骑乘行为。

计算机视觉

Zhang等人(2019b) 提出了一个基于深度学习的实时母猪行为检测算法(SBDA-DL),以识别猪的骑乘、饮水和排尿(图7(c))。该算法使用一个优化的深度学习网络 结构来直接检测母猪的行为。这以实时检测所需的处理速度提高了行为检测的准确性,满足了大多数养猪场辅助人员的日常监测要求

Li等人(2019b)开发了一种高效的学习算法,根据可见光图像的数据特征来识别猪的爬胯行为(图7(d))。基于掩膜区域卷积神经网络(Mask R-CNN)的猪分割网络被应用于提取帧中的单个猪。可以得到每头猪的兴趣区域(RoI)参数和面具坐标,从中提取特征向量。随后,用内核极端学习机(KELM)对特征向量进行分类,以确定是否发生了爬胯行为。这种方法可以有效地解决猪体部分遮挡和粘连造成的分割困难问题,即使猪体颜色与背景相似,也能识别出装束行为。

行为姿态识别

猪的姿势识别

Nasirahmadi等人(2015年)研究了使用图像处理和Delaunay三角法检测商业农场条件下猪群卧姿变化的可行性,并将其与环境温度变化联系起来(图8(a))。

Nasirahmadi等人(2019a)研究了二维成像系统是否可用于商业农场条件下的猪的侧卧和胸骨卧姿检测(图8(b))。使用背景减法将猪从其背景中提取出来。

根据二元图像的特性,找到每个动物的边界和凸体。为了确定它们的卧姿,在侧卧和胸骨卧姿下计算每个边界和凸壳的面积和周长,作为线性SVM分类器训练的输入。训练后的SVM被用来检测二进制图像中的目标姿势。

Zheng等人(2018)引入了一个检测器--Faster R-CNN。 在深度学习框架下识别五种姿势(站姿、坐姿、体侧卧位、腹侧卧位和侧卧位),并获得母猪在散养栏中的准确位置(图8(c))。该检测系统由一个获取深度图像的Kinect v2传感器和一个识别母猪姿势并定位其边界盒的程序组成。

Nasirahmadi等人(2019b)确定是否可以利用二维成像系统和深度学习方法来检测商业农场条件下猪的站立和躺卧(腹部和侧面)姿势(图8(d))。提出了三种基于深度学习的检测方法,包括具有卷积神经网络特征的快速区域(Faster R-CNN)、单次多箱检测器(SSD)和基于区域的全卷积网络(R-FCN),结合Inception V2、残差网 络( ResNet )和 Inception ResNet V2 对RGB 图像进行特征 提取。

Riekert等人(2020年)设计了一个用于位置和姿势检测的深度学习系统,该系统只需要标准的二维摄像头成像,无需对应用环境进行调整(图8(e))。这个深度学习系统应用了最先进的Faster R-CNN物体检测管道和最先进的神经结构搜索(NAS)基础网络进行特征提取。

Zhu等人(2020年)提出了一种端到端的精细化双流RGB-D Faster区域卷积神经网络(R-CNN)算法,该算法在特征提取阶段融合了RGB-D图像特征,用于识别养猪场场景中哺乳母猪的五种姿势(站姿、坐姿、胸骨卧姿、腹骨卧姿和侧卧姿)(图8(f))。基于Faster R-CNN算法,首先使用两个CNN来提取RGB图像特征和深度图像特征。然后,使用提议的单一RGB-D区域提议网络为RGB-D的两种图像特征图生成感兴趣区域(ROI )。接下来,使用特征融合层提取和合并RGB-D ROIs的特征。最后,RGB-D ROI的融合特征被输入快速R-CNN以获得识别结果。为了检测帧级母猪姿态,在时间上定位姿态变化动作,并从长时间未修剪的深度视频片段中生成时空动作管,

牛的姿势识别

Porto等人(2013年)提出了一个基于计算机视觉的系统,用于自动检测散养牛舍中奶牛的卧床行为(图8(h))。该系统由一个多摄像头视频记录系统和一个软件组件组成,该软件组件使用Violae-Jones算法执行奶牛躺卧行为检测模型。实验结果表明,本研究提出的系统可用于计算奶牛卧位指数,该指数被广泛用于调查自由放养牛舍中的奶牛卧位行为。

Li等人(2019c)开发了三个深度级联卷积神经网络模型,包括卷积姿势机模型、堆叠沙漏模型和卷积热图回归模型,以真实牛场条件下拍摄的RGB图像,进行鲁棒性牛的姿势估计(图8(i))。从以上研究可以发现,对牛的行为姿势的识别也从计算机视觉发展到了深度学习。

咬尾行为识别

目前,对猪的咬尾识别的研究还很少。Liu等人(2020b)开发了一种深度学习方法来识别和定位猪的咬尾互动。该方法使用了一个跟踪检测算法,将群体层面的行为简化为成对的相互作用。然后,一个卷积神经网络(CNN)和一个递归的 融合了神经网络(RNN),以提取空间-时间上的的特征来识别猪的咬尾行为(图9)。结果表明,通过检测跟踪的方法能够获得咬人者和受害者的轨迹。

妊娠行为识别

在最初,Yang等人(2018c)开发了一种基于计算机视觉的方法,通过使用哺乳行为的空间和时间信息来自动识别商业农场条件下的哺乳互动(图10(a))。在空间信息提取方面,母猪和仔猪在哺乳期间的空间分布被用来检测可能的哺乳事件。通过全卷积网络对母猪进行精确分割,并通过哺乳母猪的几何特性和仔猪的长度动态计算乳房区域。仔猪的空间信息在自适应的乳房区被提取出来。对于时间信息的提取,为了区分类似于哺乳的行为,从乳房区的光流中提取了关于运动强度和占用指数的时间性移动信息。结果表明,所设计的识别方法在自动识别商业猪场的哺乳行为方面迈出了重要一步。

随后,Yang等人(2019)开发了一种利用时空关系来自动识别视频中母猪哺乳行为的方法。该方法首先检测了可能存在护理互动的时空关键立方体,然后提出了时空关键立方体的定向护理流(ONuF)来进一步识别护理行为(图10(b))。在第一步中,首先在视频中使用基于光流的特征来检测时间上的关键事件,这些特征包含护理像素的分布和移动像素之间的距离,以估计整个画面的运动分布。然后,通过使用基于完全卷积网络的语义分割方法识别母猪和她的仔猪的空间位置和几何特性,定位时间关键事件中的空间关键区域。第二步,为了进一步识别哺乳行为,提出了一个新的特征描述符ONuF,估计空间-时间关键立方体的运动方向变化和运动幅度,并用于学习一个SVM分类器。

该描述符结果表明,利用全卷积网络和定向光流的时空关系的方法可用于从哺乳母猪的日常行为视频中自动识别哺乳行为。

玩耍行为识别

。Chen等人(2020d)开发了一种基于计算机视觉的方法,利用基于递归神经网络的深度学习算法来识别猪的玩耍行为并初步确定对物体的偏好。首先,开发了基于HSV(色调、饱和度、数值)色彩空间的跟踪算法,以定位感兴趣的物体区域。其次,卷积神经网络(CNN)架构InceptionV3被用来从每一帧提取空间特征。这些特征被输入到长短期记忆(LSTM)框架中,以便从每一集中提取空间-时间特征。通过全连接层,预测函数Softmax最终被用来将这些情节分类为播放或不播放(图11)。这些结果表明,所提出的方法可以用来识别猪的玩耍行为,将感兴趣区域的半径减半可以提高玩耍行为的识别精度。此外,猪对物体的偏爱也可以根据玩耍的时间来确定。所获得的玩耍行为的持续时间可以帮助农民评估所使用的充实物,从而提高他们照顾的猪的健康和福利。

综合行为识别

猪的综合行为识别

Lao等人(2016)开发了一个基于计算机视觉的系统,可以自动识别母猪在产仔箱中的行为(即躺着、坐着、站着、跪着、喂食、喝水和移位)。该系统包括一个低成本的三维摄像机,它能同时获取数字和深度图像,以及一个能检测和识别母猪行为的软件程序(图12(a))。本研究描述了用于分析深度图像的计算算法,并介绍了其在识别母猪行为方面的性能,与此同时,还介绍了对母猪行为的识别和行为识别同时进行。

牛的多种行为的识别

Fuentes等人(2020年)介绍了一种基于深度学习的具有空间-时间信息的牛的分层行为识别方法(图12(g))。该框架涉及帧级的外观特征和空间-时间信息,包含了更多的背景-时间特征。该系统可以检测(分类)和定位(边界框)视频帧中包含多个牛的行为的区域。结果表明,该系统可以有效地识别15种不同类型的牛。分为个体和群体活动的分层活动,还有部分动作。

Yin等人(2020)实现了对奶牛卧位、站立、行走、饮水和采食行为的识别(图12(h))。首先,基于Effi-cientNet的高效特征提取的优势,实现了奶牛视频帧的空间特征提取。然后,为了充分提取奶牛不同行为信息的特征,采用BiFPN (双向特征金字塔网络)实现EfficientNet 3-5层特征的有效融合。最后,将行为信息发送到BiLSTM(双向长短时记忆)模块,该模块结合了注意力机制,实现了视频帧在时间序列中的聚合,从而实现了对奶牛运动行为的快速、准确识别。

研究趋势

开发稳健的牲畜识别算法

存在的问题

用于识别的动物身体上的区域已经从身体部位转移到其他部位。 如猪脸(Hansen等人,2018;Marsot等人,2020)和牛嘴(Gaber等人,2016;Kumar等人,2018),到身体整体,此外,使用的技术已经从计算机视觉发展到深度学习。

移动的动物上的局部区域很难定位,它需要动物合作进入指定区域以获得局部图像,这可能涉及到人为干预。

未来对牲畜的识别将朝着身体整体的方向发展

举例

基于Gabor滤波器局部二进制模式的计算机视觉方法(Huang等人,2018)的性能会因为猪与猪之间的接触或重叠而受到影响。

此外,当猪的数量大量增加时,基于Faster R-CNN的深度学习方法(Yang等人,2018b)的性能可能会降低,特别是在一些欧洲猪场的保育栏中,猪的数量有时超过30 头(Nasirahmadi等人,2019a,2019b)。这是因为基于深度学习的物体检测算法(如CNN架构Faster R-CNN(Girshick,2015)、SSD(Liu等人,2016)和YOLO(Redmon等人,2016))主要用于不同类型物体的分类,而猪在同一猪栏中往往是相似的。即使在CNN和LSTM架构识别牛的案例中(Qiao等人,2019b),CNN架构的表现将决定最终的识别结果,因为CNN主要提取图像中的空间特征,而LSTM只融合这些时间维度的空间特征。因此,CNN架构的改进已经成为鲁棒性牲畜识别的主要研究方向之一。

对不同生长阶段的牲畜行为的识别

目前对家畜行为识别的研究主要集中在动物的特定生长阶段,如哺乳期(Yang等,2019)、保育期(Chen等,2020a)和育肥期(Li等,2020)。

由于猪体大小和放养密度不同,一个阶段的家畜行为识别算法在用于另一个阶段的行为识别时,其性能可能会受到影响。

存在问题

通常育肥母猪圈的猪只数量较少,圈舍也比较松散(Zhang等,2019b),而保育仔猪圈的猪只数量和放养密度较大,在猪只饮水时,会产生较多的猪只之间的遮挡、接触和重叠(Chen等,2020b)。

因此,在育肥猪舍开发的饮水识别算法用于识别保育猪舍中的猪只饮水时,其性能可能会降低。在为了解决这个问题,深度学习技术,例如CNN和LSTM架构(Donahue等人,2015;Srivastava等人,2015),可以用来提取牲畜不同生长阶段的同一行为的空间-时间运动模式,以识别这种行为,因为深度学习有能力将大量数据训练成一个稳健的模型。另一方面,如果不同生长阶段的同一行为的运动模式有很大差异,可以重新训练训练过的模型。

行为识别结果的进一步量化

近年来,基于计算机视觉和深度学习的家畜行为研究主要集中在对某一特定行为的识别上,如攻击性(Chen等,2020a)、饮水(Chen等,2020b)、采食(Chen等,2020c)、跛行(Jiang等。2020)、装束(Li等,2019b)、姿势(Zheng等,2020)、咬尾(Liu等,2020b )、哺乳(Yang等,2020)和玩耍(Chen等,2020d),或对多种行为进行分类,如喂食、躺卧、行走、抓挠和装束(Zhang等,2020);Li等,2020)。

然而,这些家畜行为的识别或分类结果还需要进一步量化。

目前的研究主要集中在对猪进食的识别和对每头猪进食时间的量化(Yang等人,2020;Chen等人,2020c)。虽然饲料摄入量、餐长、餐间隔、每天吃的餐数和总的进食时间(Marcon等,2015;Adrion等,2018;Cross等,2018)也有必要进行量化,因为猪吃的饲料数量的变化可以表明环境、健康或社会压力(Matthews等,2016)

,也可以用来预测疾病的爆发,例如肺炎(Brown-Brandl等,2016)。因此,对行为识别结果的进一步量化已成为未来牲畜行为识别的重要研究方向之一。

建立生长状况、健康和福利的评价体系

采食和饮水可以直接反映家畜的生长状况(Botreau等,2007)。

攻击、跛行、骑乘、咬尾会造成动物的皮肤创伤、感染,甚至是致命的伤害,这与动物健康密切相关(Turner 等,2006 ;Bruijnis 等,2012 ;Teixeira 和Boyle ,2014 ;Larsen等,2019)。

姿势估计也是评估动物健康的一个关键步骤(Yazdanbakhsh等,2017)。

护理和游戏主要反映了动物福利(Muns等人,2013;Lahrmann等人,2018)。

对于生长状态、健康和福利的评价方面,很少有参数可以在行为识别的再结果与动物的生长状态、健康和福利之间建立关系。

喂食/饮水量或动物体重的参数可以被量化,并与喂食和饮水的识别结果相联系,以评价动物的生长状况。

。皮肤创伤程度的参数可以被量化,并与攻击性、跛行、骑马和咬尾的识别结果相关联,以评估动物健康。

此外,对不同充实物的偏好参数可以被量化,并与玩耍的识别结果相联系,以评估动物福利。

因此,建立生长状况、健康和福利的评价体系是用于建立牲畜行为识别结果与相关评价参数之间关系的主要研究方向