导图社区 Eeg分类算法

- 41

- 0

- 0

- 举报

Eeg分类算法

Eeg分类算法思维导图:包含线性分类器,每个类的特征向量之间的线性决策边界,神经网络可以用来近似任何非线性决策边界等等

编辑于2022-04-06 14:36:53- EGG

- Eeg分类算法

- 相似推荐

- 大纲

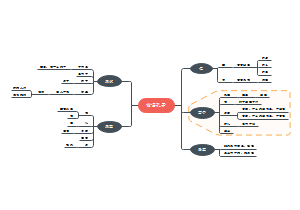

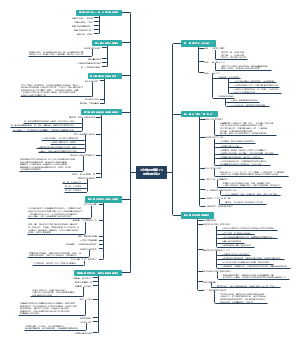

EEG分类算法

2007年之前

线性分类器linear classifiers每个类的特征向量之间的线性决策边界

线性判别分析LDA

fisher-LDA

收缩sLDA

正则化LDA

支持向量机SVM

神经网络neural networks可以用来近似任何非线性决策边界

多层感知机MLP

高斯分类器神经网络Gaussian classifier NN

学习矢量量化神经网络LVQ NN

非线性贝叶斯分类器non-linear Bayesian classifiers利用概率分布和贝叶斯规则进行分类

贝叶斯二次分类器Bayes quadratic classifiers

隐藏的马尔科夫模型 HMMS

最近邻分类器 nearest neighbour classifier当前特征向量的最近邻

K近邻 NN

Mahalanobis distance classifiers

分类器的组合 classifier combinations

boosting voting and stacking combination algon‘thms分类器组合似乎是基于脑电的BCIs中表现最好的分类器之一

2007年至今

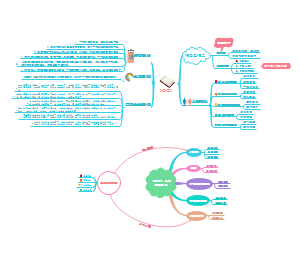

自适应分类器 adaptive classifiers:分类器的参数随着新的脑电图数据而逐步重新估计和更新。分类器能够跟踪可能变化的特征分布,从而对非平稳信号中也能保持有效的分类结果

监督自适应supervised adaptation

原理:输入的脑电图信号其真正的类标签的是已知的,分类器在可用的训练数据加上新输入的数据组成的数据集上被重新训练,利用新输入的数据进行补充和更新分类器

算法

自适应LDA——基于卡尔曼滤波的自适应LDA算法来跟踪各类的分布

基于序贯蒙特卡罗采样的自适应贝叶斯分类器

自适应支持向量机(SVM)

基于随机梯度的自适应线性分类器

离线BCI

passive-aggressive(被动-回归)算法(在线)

自适应LDA QDA(二次判别分析)

自适应概率神经网络

分类器的集成搭建监督自适应分类器

在线BCI

优缺点:监督自适应是最有效的EEG分类自适应分类器,优于静态分类器。但监督自适应分类器在BCI的使用上不是free,它需要有指导的用户训练,对用户的指令进行训练,从而得到相应的脑电图类标签。

无监督自适应unsupervised adaptation

原理:无监督自适应是基于用于再训练/更新的数据类标签的估计或者是基于class-unsupervised adaptation(所有EEG信号的均值和协方差矩阵)。基于估计的原理

算法

高斯混合模型估计GMN

模糊C均值Fuzzy C-means(FCM)

用于自适应LDA分类器跟踪类的均值和协方差

扩展卡尔曼滤波器,用于非线性贝叶斯滤波器追踪AR参数

基于误差梯度的增量逻辑回归分类器

高斯概率分类器

根据增强信号(RS)的ErrP的概率更新类的均值和协方差

优缺点:优于静态分类器,但是鲁棒性不强,需要更加健壮的无监督自适应分类器

半监督自适应semi-supervised adaptation

原理:使用初始标记数据和输入的未标记数据来适应分类器。使用步骤:(1)最初在可用的标记训练数据上训练有监督的分类器,然后(2)通过用该分类器估计进入的未标记数据的标记,以及(3)通过调整/再训练分类器使用分配给它们的估计标签的这些最初未标记的数据与已知的可用标记的训练数据相结合。

算法

半监督自适应SVM ERP-BCI

贝叶斯LDA P300-BCI

核判别分析(KDA)分类器

CSP+LDA

MI task

优缺点:离线数据分析显示半监督方法导致比完全监督方法有更高的比特率,需要更多的监督数据训练。另一方面,以LDA作为分类器的离线半监督自适应算法在MI task数据上失败,这可能是由于LDA对错标的鲁棒性差造成的

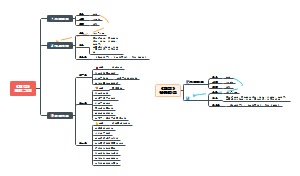

矩阵和张量分类器matrix and tensor classifiers

黎曼几何投影分类

原理:Riemannian几何分类器(RGC)的思想是将数据直接映射到具有适当度量的几何空间,而不是估计空间过滤器和/或选择特征。采用非欧几里得距离的外部距离度量特征。机器学习扩展到流形学习。EEG中常用的流形为埃尔米特矩阵(Hermitian)和对称正定矩阵(PSD)流形(manifolds)处理EEG的协方差矩阵;Stiefel和Grassmann流形(manifolds)处理子空间和正交矩阵

算法

黎曼最小距离平均(RMDM)分类器

投影到切线空间+标准分类器,Tangent space+LDA/SVM/逻辑回归

SVM Riemannian Kermel

优缺点

优点:1、较强的噪音鲁棒性和泛化能力2、分类精度高3、处理过程和方法简单4、适应多种BCI方式5、无参数分类器,不需要参数调整6、较好的泛化能力

缺点:1、对数运算病态和数值不稳定2、黎曼方法具有很高的计算复杂度(随着计算几何平均值和黎曼距离的电极数量的增加而增加)3、噪音随数据维度的增加而增加

其他矩阵分类器

原理:空间滤波和分类器参数的双重优化产生的解是次优解,因此需将双重优化问题转化为单一优化问题。这些方法的关键原则是学习直接使用协方差矩阵作为输入的分类器(线性矢量分类器或矩阵分类器),或者它们的矢量化版本。

算法

EEG data使用协方差增广矩阵A代替,矩阵的权重为W(非vertor),决策函数为f(A,W)=<A,W>+b。维度较大需要矩阵正则化稀释时间和空间

构建张量矩阵

优缺点

优点:将空间滤波优化和分类器优化的双重优化问题转化为单一优化问题获得更优解,提高了分类性能

缺点:输入特征的维度较高,必须采用合适的正则化方法,计算复杂度较高,暂无法在线使用

使用张量的特征提取和分类

原理:张量(多维阵列)提供了EEG数据的自然表示方法,高阶张量分解用于EEG数据的分析很有前景。特别适用与BCI任务中的特征提取、聚类分析和模式分析。space-time-frequency分析

算法

SVM的扩展——>张量支持机TSM(tensor support machine)/Kemel TSM/Higher Rank TSM

标准LDA的扩展——>张量fisher-LDA(TFDA)/高阶判别分析(HODA)

优缺点

优点:张量的方向性为高维BCI数据的分析提供了有力和前景的工具,大规模数据的降维分析

缺点:复杂度高、算法暂时不成熟待优化

迁移学习transfer classifiers

原理:机器学习的假设是遵循相同的概率分布,迁移学习的目的是通过利用在学习某一特定任务时获得的知识来解决另一项不同但相关的任务,从而处理违反这一假设的数据。迁移学习是一组考虑用于基于在学习另一任务时获得的信息来增强在一个任务(也称为域)上训练的学习分类器的性能的方法。

特征提取+分类算法

CSP+bandpower Linear SVM/multi subject LDA

稀疏特征集Space feature set LDA

表面拉普拉斯变换Surface Laplacian subject-to-session LDA+Bayesian multitask

PCSP subject-to-subject LDA+Bayesian model

字典学习Dictionary learning session-to-session linear SVM

Mltask

优缺点

优点:在session-to-session和subject-to-subject分类性能提升,解决脑电信号分类因人而异的问题,算法健壮、计算复杂度不是很高,可适合在线应用。

缺点:由于训练为通用的分类器其分类精度为次最优的,学习时间较长。

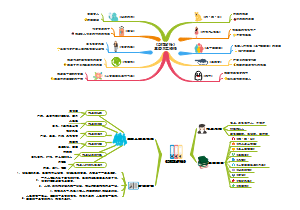

深度学习deep learning

原理:深度学习是一种特殊的机器学习算法,特征和分类器直接从数据中联合学习

算法

用于EEG分类的卷积神经网络CNN

用于EEG分类的卷积神经网络(CNN)+自动堆叠编码器(SAE)

用于EEG分类的受限玻尔兹曼机

自动堆叠编码器

深度信念网络(DBN)

深度极限学习机(DELM)

卷积神经网络+深度信念网络(CNN+DBN)

优缺点

优点:理论上可以实现EEG更有效的特征提取算法和精度高、性能稳健的模式分类算法但实际中与先进的BCI算法相比较缺乏说服力

缺点:DNN的训练需要fed大数据,目前EEG的数据量较少。训练时间无法在线使用。训练和测试的计算复杂度都很高

多任务分类器

主要方法一,使用多类技术直接分类

决策树

多层感知器

K近邻

朴素贝叶斯

主要方法二,多分类分解为多个二分类

一对一对分类器

一对剩余或者一对所有分类器

类似二叉决策树的层次分类器

多标签分类器

当前EEG分类算法的挑战

EEG信号的低信噪比,时间上的非稳态随机性

受试者EEG信号的因人而异

训练数据有限,如何从有限的数据集实现多分类