导图社区 APA自动泊车系统需求

- 169

- 1

- 0

- 举报

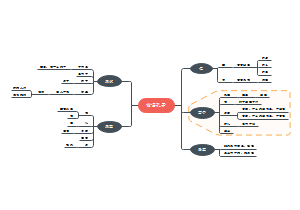

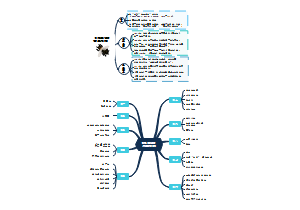

APA自动泊车系统需求

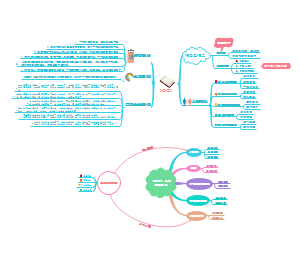

自动泊车是指汽车自动泊入停车位,不需要人工控制。通常我们见到的自动泊车有两种形式,半自动泊车和全自动泊车。半自动泊车指的是在泊车过程中系统只帮你控制方向盘,但挡位还需要人来介入控制。另一种就是全自动泊车,油门刹车、挡位全部由系统控制,针对车位作出自动的判断、控制和行为。目前搭载该功能的车辆可以实现侧方位停车、竖直停车、斜方位停车等等。

编辑于2022-06-07 23:22:05- 自动泊车系统

- 相似推荐

- 大纲

APA自动泊车系统需求

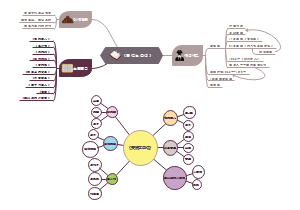

整车布置需求

摄像头视野覆盖范围

前视覆盖范围测试

正前 20m

环视覆盖范围测试

前后 15m

左右 11m

泊车传感器安装验证<br>

前视

安装方案

环视

安装方案

超声

UPA

距离要求:2.5m

波束角:120°<br>

APA

距离要求:5m<br>

波束角:60°<br>

IMU F9K安装

后轴中心

X,Y,Z坐标偏差<br>

<5mm<br>

pitch、yaw、roll偏差<br>

<0.4°<br>

摄像头标定<br>

内参标定<br>

外参标定<br>

产线标定

精度要求

位置<2cm

姿态<0.5°

售后标定<br>

道路标定(斑马线,车道线)

标定时间<3min

在线标定

后台自动运行摄像头标定程序,结合GNSS、IMU,在车道线清晰的场景下,可以自动完成参数更新;<br>

超声波指标

探测距离<br>

APA:>5m<br>UPA:>2.5m

障碍物为 ISO Pole:直径 Ø75, 高度 1 米的 PVC 管<br>

最远探测距离<br>

APA:> 5m<br>UPA:> 3.5m<br>

障碍物为墙面<br>

近距离盲区

<10cm<br>

障碍物为 ISO Pole:直径 Ø75, 高度 1 米的 PVC 管

距离误差

<1.5m,误差<1cm<br>>1.5m, 误差<3cm<br>

距离分辨率

1cm<br>

障碍物更新速率

UPA>12Hz<br>APA>24Hz<br>

单次检测障碍物回波个数

>=3个

余振值

UPA/APA<1.3ms(全温度范围)

数据传输延时<br>

<10ms

功能安全等级

ASIL-B

超声波诊断

距离值异常

状态错误

定位传感器指标

GNSS

位置精度

SBAS: 1m CEP <br>RTK: 0.2m + 1 ppm CEP<br>

速度精度<br>

0.05m/s<br>

Yaw精度<br>

0.2 deg

冷启动时间<br>

<30s<br>

热启动时间<br>

<3s

1pps精度<br>

RMS: 30 ns <br>99%: 60 ns

输出频率<br>

Priority navigation mode: 30Hz <br>Non-priority navigation mode: 2Hz

延迟<br>

Priority navigation mode: 15 ms

IMU ASM330

信号需求

时间戳

X轴加速度

Y轴加速度

Z轴加速度

X轴角速度

Y轴角速度

Z轴角速度

测量范围<br>

±2000

±16g

陀螺仪偏移<br>

1.0 dps<br>

加速度计偏移<br>

5mg<br>

输出频率

100Hz<br>

延迟<br>

<10ms

功能安全要求<br>

ASIL-B

车辆标定<br>

底盘信号

Yawrate(偏航角速率), Speed(速度), Gear(挡位)<br>

性能要求

频率>=50Hz 延迟<10ms

Steering angle(转向角)精度 < 0.1度<br>

Yawrate(偏航角速率) 精度要求 < 1度/秒<br>

Speed(速度)误差<2%<br>

轮速、轮脉冲和轮速方向的信号输出<br>

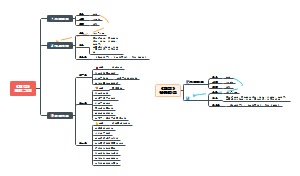

硬件需求

主处理芯片<br>

J3A

处理前视8M摄像头感知输入<br>

J3B

处理周视和后视2M摄像头感知输入

视觉建图

J3C

处理环视摄像头感知输入

IMU TC397<br>

运行规控相关算法和超声波相关感知

以太网连接<br>

内存<br>

单通道4G LPDDR4 3200 32bit

存储器<br>

NOR Flash

64MB<br>

EMMC

8GB

接口需求<br>

CAN接口<br>

8路

CAN0:域控制控车接口<br>

CAN1:底盘冗余<br>

CAN2:动力冗余<br>

CAN3:前向毫米波雷达<br>

CAN4:前向毫米波角雷达<br>

CAN5:后向毫米波角雷达<br>

CAN6-7:预留

以太网接口<br>

3路(1路千兆+2路百兆)+1路(1路调试用千兆以太网)

摄像头输入

10路(1路8M前视+4路2M环视,行车还需要增加4路周视+1路后视)

摄像头输出<br>

3路(1路4路环视bypass,1路4路环视拼接后透传,1路前视透传支持DVR)<br>

超声波输入接口<br>

DSI3传输协议<br>

GNSS天线<br>

1路Fakra天线信号输入

CAN接口唤醒<br>

特定帧唤醒

任意帧唤醒<br>

CAN接口内部连接

CAN收发器直接连接在MCU上<br>

以太网数量<br>

1路千兆以太网<br>

接车内网关,并且预留未来接入激光雷达数据能力<br>

1路百兆以太网<br>

传输整车内部相关数据,包括相关控制信号、本地视频存储等<br>

1路百兆以太网<br>

传输车辆和云端直接通讯的相关信号,包括远程启动、数据回传、远程视频监控等数据信号<br>

1路千兆调试以太网<br>

用于J3调试

以太网配置<br>

以太网switch由MCU进行配置

前视接入<br>

1路前视摄像头GMSL信号通过4合1的fakra接口连接MAX9296,再通过4路lane连接J3A的MIPI-RX1/RX3;<br>

另外4路lane连接MAX96717F,同时bypass出去给车机

周视接入<br>

4路周视接入

1路输出给车机

后视接入<br>

1路后视接入<br>

多路摄像头同步曝光<br>

每一路摄像头需要能够通过SYNC端口进行硬线曝光控制<br>

摄像头曝光控制输入精度需要能达到250us(待定)<br>

多路摄像头配置需求<br>

环视摄像头bypass输出<br>

4路环视YUV图经过MAX96717F后,由4合1的fakra输出

环视摄像头拼接输出(TBD)<br>

4路环视RAW图进入J3C处理拼接后后,通过MAX96717F输出<br>

前视摄像头DVR功能输出支持<br>

1路前视输入J3A后,通过J3A内部的ISP处理,输出给MAX96717,加串后通过FAKRA输出给外部车机使用;

超声波接口芯片需求<br>

超声波采用DSI3协议,发送端芯片选用3片521.42来实现驱动外部12个超声波雷达

具体分配方式<br>

超声波sensor与MCU连接方式<br>

超声波雷达前后两组,可以通过MCU分别切换上电模式

调试接口需求_1<br>

调试阶段,需要支持UART串口调试功能(每颗J3均需要)<br>

调试接口需求_2<br>

具备SD卡插槽(J3-A需要)<br>

调试接口需求_3<br>

预留一路千兆以太网,用于J3调试需求,对外使用RJ45接口<br>

调试接口需求_4<br>

预留一路MCU调试接口<br>

GNSS<br>

采用板载F9K,对外通过fakra接口连接外部天线,内部通过串口和GPIO连接J3A<br>

IMU<br>

采用板载ASM330,内部通过SPI连接J3A

电源管理需求_1<br>

硬件可支持车载12V KL30蓄电池供电,地信号与整车地相接;

电源管理需求_2<br>

唤醒方式:支持车载KL15硬线唤醒,次优先级支持CAN网络唤醒,唤醒功能由MCU完成<br>

电源管理需求_3<br>

电源诊断:需要支持供电的欠压、过压诊断

电源管理需求_4<br>

支持反向电压保护<br>

硬件监控和复位要求_1

MCU需要通过J3 ERR PIN和SPI端watchdog信号对J3进行监控([Comment]鉴于PWM口资源紧张,ERR PIN不建议占用PWM端口)<br>

硬件监控和复位要求_2<br>

MCU在监控J3异常情况下,要能够通过RST PIN对J3进行复位<br>

内部通讯需求_SPI<br>

J3与MCU之间需要具备SPI+GPIO,支持单路全双工<br>

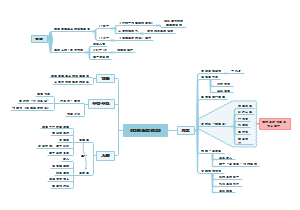

系统软件需求

系统需求_OS<br>

操作系统默认需支持Linux<br>

系统需求_负载需求<br>

CPU: 平均需<80%,峰值需<90%;<br>BPU: 平均需<80%,峰值需<90%;<br>通信负载要求:≤50%,峰值需<80%;<br>正常工况: 一个完整的drive cycle 完成。<br>极限工况:把所有功能全部打开,连续Parking 至少2个小时以上

系统需求_启动时间需求<br>

启动时间:系统启动时间,从系统上电至功能信号输出需要<6s,每颗J3功能分配参见应用软件功能分配

启动时间定义:从上电开始到输出感知结果和规控结果,进入可正常工作状态

图像接入需求<br>

前视摄像头采用8M AR0820

对于J3A,需要支持单路8M接入,图像格式RAW12,帧率30Hz,解串器型号MAX9296

环视采用2M ISX031

对于J3C,需要支持4路2M(1920*1440)接入,图像格式YUV422,帧率30Hz,解串器信号MAX96712

环视(TBD)预留J3C,直接接入环视RAW12格式的通路,帧率30Hz,解串器型号MAX96712

周视采用2M AR0233

此部分参考pilot3.0需求

后视采用2M AR0233

(周视详见pilot3.0要求,泊车无需周视)

系统需要支持以上sensor

摄像头控制需求_配置启动时间

配置启动时间,从上电到第一帧图片输出时间,单路200ms,多路400ms

摄像头控制需求<br>

配合硬件,J3可以通过I2C获取摄像头和解串器状态,进行配置<br>

配合硬件,J3可以通过GPIO对摄像头及解串器进行复位和电源控制<br>

J3需要通过LPWM端口对摄像头进行曝光控制,精度要求250us

环视摄像头IPM图处理需求<br>

采用J3内部GDC模块,实现四路鱼眼的IPM图输出

环视摄像头拼接需求<br>

2D拼接重叠区域线错位要求:≤5cm(5m内);拼接区域≥10m<br>

3D拼接重叠区线错位要求:平面5cm(5m内)

外部供应商满足<br>CPU占用率<0.3个核(A53)<br>输出帧率≥25fps

环视摄像头拼接需求<br>

基于环视和超声波数据融合,通过对拼接区域的自适应调整将拼缝处的障碍物正常显示出来;<br>拼缝调整可使用固定角度,0°,45°,90°

具备非平整路面校正功能

具备去鬼影校正功能<br>

具备动态光影校正<br>

具备夜视补光功能<br>

图像Bypass需求_DVR<br>

图像Bypass需求_车机AVM<br>

图像Bypass需求_车机AVM_2(TBD)<br>

摄像头热插拔需求<br>

在实际应用中,由于物理中断或高频干扰而造成信号中断,需要对摄像头端完成视频接受锁定。当信道建立过程中发生某种异常而导致无法建立,需要重新配置,多次配置无效后认定为故障状态

摄像头快速出图需求<br>

当AVM功能未初始化完成时,用户挂R档进入AVM界面,此时显示后视原图,无法切换视角,不响应其他输入;时间要求2-4s(系统冷启动时间,从网络唤醒开始)

图像采集压缩回传需求<br>

需支持对图像的DDR缓存、落盘存储,支持DVR功能<br>

需支持USB3.0传输,用于raw图像传输

其他传感器需求

通讯需求

通讯包括板级内的芯片间通讯,也包括与外部设备的ETH通讯

通讯需求_ ETH网络要求<br>

带宽支持100M/1000M自适应,PHY支持RJ45及1000BASE-T1

通讯需求_SPI要求<br>

带宽支持10M/15M/20M,默认15M,支持单路全双工和双路单工两种模式

系统管理需求<br>

系统需要监控主要应用App进程的运行状态,与MCU保持心跳信号,在应用进程异常时可以对其进行重启<br>

时间同步需求<br>

SOC和MCU实现同步

OTA需求<br>

与诊断设备交互:需要基于DoIP+UDS规范(该方面基于客户定制触发,目前在PDT中不做要求)<br>

分区与存储需求<br>

分区:具备Veeprom/SPL/boot/kernel/userdata/log/recovery等分区

诊断需求<br>

能够对故障事件进行管理和记录,并能够以消息方式,通过ETH向外发送诊断状态<br>

应用软件需求

软件功能需求<br>

子主题

算力配置<br>

J3A

记忆模式<br>

前视感知:2*ARM+2*BPU<br>规划决策(可能会用APA):0.5*ARM

使用模式<br>

前视感知:2*ARM+2*BPU<br>规划决策:2*ARM<br>

J3B<br>

记忆模式

环境融合(鱼眼+前视静态要素):1*ARM<br>地图引擎:0.5*ARM<br><span style="font-size: inherit;">实时建图:2.5*ARM(语义结构化都在重建融合环节实时完成,特征点用此资源预先计算)<br>收尾建图:4*ARM</span><br>

使用模式

环境融合(鱼眼+前视+地图静态要素):1*ARM<br>定位融合(鱼眼+前视联合):2.5*ARM<br>地图引擎:0.5*ARM<br>

J3C<br>

记忆模式

鱼眼感知(内部4个鱼眼先自己融合):4*ARM+2*BPU<br>(鱼眼+前视运动目标在此融合)<br>(包括鱼眼定位特征点)<br>

使用模式

鱼眼感知(内部4个鱼眼先自己融合):4*ARM+2*BPU<br>(鱼眼+前视运动目标在此融合)

MCU

记忆模式

超声波感知;<br>控制;<br>

使用模式

超声波感知;<br>控制<br>

软件功能要求<br>

芯片间感知、定位、规划、控制主要应用的信号传输基于ETH之上的统一通用传输协议(zmq或dds)。<br>对不支持此类传输协议的MCU可基于TCP/UDP或SPI<br>

具备系统状态管理,能够识别感知、定位、决策、车辆的故障状态,并能够进入Fail-Safe状态

在外部条件触发下能够进入标定状态.<br>在标定未完成、和未标定状态下不允许进入自动驾驶状态

动态调节感知及后处理,能灵活支持4~5V场景,BPU负载率需<90%<br>

感知、定位、融合、规控能够遵循统一的软件框架。<br>互不耦合的模块不影响相互独立运行,例如规控输入一些场景要求或标签要求给感知,但规控挂掉后不应影响感知的运行。

软件性能要求

前视感知通路延时小于100ms<br>

环视的通路平均延时小于150ms<br>

前视感知帧率:30fps<br>

环视融合后输出帧率:≥20fps,最优为30fps<br>前视+后视+周视融合后输出帧率:≥20fps,最优为30fps

软件算法需求

环视感知(模型)有效范围要求

基于AVM环视系统的4路鱼眼摄像头,检测车辆周围的特定物体,从而对驾驶员进行预警,甚至主动控制决策,如减速和刹车<br>

检测车辆周围特定物体的视觉感知,必须采用实时且高性能的目标检测算法,满足项目的功能安全要求(QM, TBD)

具体需求<br>

工作车速:0~30km/h (TBD, 最大车速与AVM工作的最大速度一致)<br>环境要求:光线在10~100000 lux, 实时雨量不高于小雨、实时雪量不高于小雪,能见度不低于200米<br>目标类型:行人、骑行者、车辆、地锁、锥桶/禁停牌等(详细类型见感知模块要求)<br>环视检测范围:车辆前后20m内(车辆20m/行人15m),车身左右各10m内

注: 目标检测的最远距离,取决于目标的成像大小和清晰度,对于小目标的要求,0.8m的小孩,最远检测距离不低于15米,通用地锁/锥桶的最远检测距离不低于3米

前视感知检测

车辆

VRU

施工障碍物<br>

泊车前视包括锥桶、三角警示牌、施工牌、立式限位杆

施工障碍物需增加禁停牌和水马

减速带<br>

前视静态目标中,增加减速带

地面标识<br>

前视静态目标增加地面箭头

道闸<br>

前视静态mu目标增加道闸;给出准确的道闸位置信息

前视需判断道闸的开关状态

转向标识<br>

前视增加转向标识的识别

立柱<br>

前视增加立柱的识别,对于立柱要求:<br>立柱直径≥30cm

车道线<br>

道路边界<br>

道路边界类型在以下基础上,增加灌木丛,并给出分类信息

环视感知检测_输入要求

前环视<br>

左环视<br>

右环视

后环视

环视拼接图片

环视IPM感知检测

车位环境需求

工作车速:0~30km/h;<br>环境要求:<br>光线在10~100000 lux, 实时雨量不高于小雨、实时雪量不高于小雪,能见度不低于200米<br>场景要求:<br>地下停车场路面、斜坡、带减速带路面、水泥沥青路面、环氧地面、大理石地面、植草砖地面、库位线存在部分磨损等场景。<br>车位线颜色包括白色、黄色<br>车位线类型包括T型、矩形、菱形,并允许后续扩展到平行线等其它线型

车位检测范围要求<br>

检测范围:<br>在车位与车辆后轴中心距离(车位四个角点中最近角点距离车辆后轴中心的直线距离)12m范围内的情况下,对车位进行记忆跟踪。<br>搜索入口角点距离车身侧面0.3m~6.0m的车位。<br>根据控制器划定的ROI范围进行车位搜索

车位检测其他要求

对于不同车型,不同轮胎尺寸,不同载重均需满足精度高度要求;<br>支持对检测结果进行平滑滤波;<br>车位角点在规定的距离范围内,满足停车位角点坐标精度要求的情况下,认为停车位检测正确;否则停车位检测错误

环视感知障碍物检测环境要求

工作车速:0~30km/h; (行车指标考虑,能否兼容)<br>环境要求:<br>光线在10~100000 lux, 实时雨量不高于小雨、实时雪量不高于小雪,能见度不低于200米

车位要求<br>

停车位空与非空的置信度:<br>通过停车位置信率以及置信度阈值来判断当前场景是否支持车位检测<br>对于障碍物存在部分遮挡、不同的天气环境、不同的光线环境,支持通过置信概率以及置信度阈值来判断当前环境是否支持停车位检测<br>

车位类型输出:<br>水平车位、垂直车位、斜向车位(30°/45°/60°);<br>对于斜列式车位,需要输出车位的角度

停车位状态:空/非空判断;<br>基于车辆尺寸与车位尺寸判断是否可使用(TBD);<br>基于车位内障碍物判断是否车位可使用

结合特殊字符及图案的检测结果,对于禁停车位、残疾人车位,应输出车位不可用<br>

停车位角点坐标:车体坐标系中的坐标;<br>输出停车位四个车位角点在车位坐标系下的坐标

停车位角点坐标:图像坐标系中的坐标;<br>输出停车位四个车位角点在图像坐标系下的坐标<br>

停车位ID:<br>非停车位字符;<br>单帧最多输出10车位,单侧最多5个,双侧10个;<br>根据车位至本车距离对车位排序

角点检测质量: 0-99

车位字符识别结果: 识别车位入口的数字和英文字母<br>

召回率(Recall)>95%<br>

准确率(Precision)>95%;<br>车位角点在规定的距离范围内,满足停车位角点坐标精度要求的情况下,认为停车位检测正确;否则停车位检测错误

停车位坐标平均测距精度:10cm(≤3m);20cm(3~5m);(80%的ODD场景要求)<br>与环视摄像头距离:将直线距离投影到水平地面的距离

停车位类型精度:<br>水平、垂直、斜列式分类准确率:>95%<br>斜列式车位角度识别准确率:>95%<br>

停车位状态精度:<br>基于车位尺寸进行分类准确率(不可泊入的尺寸明确为:长度小于车长,宽度小于带后视镜的车宽)>98%(尺寸待定)<br>基于障碍物占用情况进行分类准确率(小型障碍物如地锁锥桶完全在车位线范围内的认为不可泊入,大型障碍物如车辆侵入车位线的认为不可泊入)>98%

环视IPM Parsing(分析)感知检测

分割类型要求

道路;<br>背景;<br>车道线;<br>标志线;<br>停车线;<br>停车位;<br>限位杆;<br>地锁;<br>行人/车辆;(待定)<br>

环视感知障碍物检测环境要求

工作车速:0~30km/h; (行车指标考虑,能否兼容)<br>环境要求:<br>光线在10~100000 lux, 实时雨量不高于小雨、实时雪量不高于小雪,能见度不低于200米

环视感知检测

车辆<br>

车辆,包括SUV、轿车、卡车、公共、三轮车汽车等四种;(三轮车确认)<br>

非机动车辆,包括婴儿车、摩托车、电瓶车、自行车、超市手推车、货物手推车等(前期依赖Freespace和超声波判断,后续补充增加分类)<br>

对车辆目标,需具备对车辆的2D和3D检测,能够输出车辆位置、朝向、长宽高,能够识别出车头、车尾<br>

能够对车辆进行多个朝向的感知,包括后向、前向、侧向以及混合朝向。(待确定)

当目标被遮挡/截断70%以内时,视觉系统需要能检车辆的头部、尾部、横向<br>遮挡30%-70%能够检测<br>遮挡<30%保证稳定检出<br>note: 遮挡超过70%,如有输出,不应被强行过滤<br>

在车辆被遮挡或者部分不可见时,能够预测出整车目标的检测框

VRU

目标VRU类型:成人(1.5m-2.3m高),小孩(0.6m-1.5m),骑车人<br>

对被遮挡行人、骑车人,需要能检测出以下情况:<br>1. 行人:>1/2可见<br>2. 骑车人:>1/2可见

需要检测出站立、行走、奔跑状态下的行人<br>

行人朝向方向:支持4个朝向,朝前、后、左、右(可选:8个方向)

后处理<br>行人测速:0-15kph <br>总体:1.5m/s(Average Error),3m/s(90%)(补充具体含义)<br>速度:0-50kph<br>总体:1.5m/s(Average Error),3m/s(90%)<br>

一般障碍物要求

锥桶

水马

禁停牌

地锁,并给出开闭合状态;<br>仅检测打开状态的地锁,贴地状态(不影响车辆行驶)的地锁不检测;(待确认)

立式限位杆

目标置信度:0-99<br>明确可以被采纳为可信障碍物的置信度阈值<br>对于障碍物存在部分遮挡、不同的天气环境、不同的光线环境,支持通过置信概率以及置信度阈值来判断当前环境是否支持障碍物检测

目标位置坐标:<br>车体坐标系中的坐标<br>图像坐标系中的坐标

静态目标要求

减速带

车轮定位器:对阻车器的内侧边缘进行检测

地面标识

人行横道

转向标志

车辆

车辆目标长宽高,和长宽高的标准差(TBD)<br>

目标车辆3D框角点输出

环视感知指标

障碍物

障碍物检测指标: 召回率(Recall) >99%

准确率(Precision)>97%<br>障碍物最近接地点满足障碍物接地点坐标精度要求的情况下,认为障碍物检测正确;否则障碍物检测错误;障碍物遮挡部分行人≤30%、车辆≤70%<br>

障碍物坐标精度:<br>相对距离0m~2m以内:±10cm以内;<br>相对距离2m~5m以内:平均误差:<10%;最大误差:<20%<br>相对距离5m~10m之间: 平均误差:<15%;最大误差:<30%<br>相对距离10m-20m之间: 平均误差:<20%;最大误差:<30%<br>只评测障碍物接地点中最近接地点的误差与环视摄像头距离:将直线距离投影到水平地面的距离

障碍物运动状态精度:运动静止>90%(人和车)

障碍物相对本车运动方向检测准确率<45度(90%)

障碍物相对地面运动方向检测误差<45度(90%)

车辆

车辆目标长宽高,和长宽高的标准差(TBD)<br>

目标车辆3D框角点输出

车辆标签

目标运动状态:<br>1. 静止(相当于stationary)<br>2. 停止基于车辆历史运动状态(相当于stopped)<br>3. 运动<br>4. 未知<br>5. 无效

目标车辆有效标志:1.有效(stable);2.无效(unstable)

车辆是否为新生成的目标:1.本周期新生成目标;2.先前周期跟踪目标

目标车辆是否为预测车辆:1.预测的目标;2.测量到的目标

环视感知FreeSpace检测环境要求

为了规划安全路径,合理避障,需要探测感知行车和泊车路径上的各种障碍物。因为目标检测算法只能感知特定目标类型和一定成像大小(≥24 x 24 pixel)的障碍物,如行人、骑行者、车辆和地锁等静止障碍物,对于路沿和各种路障(如栅栏、树丛等),还无法探测,所以需要考虑可行驶区域检测的冗余感知算法

为了更精确地探测各种障碍物的位置和大小,规划行驶安全路径,合理避障,采用语义分割检测算法,探测可行驶区域和各种已知类型的目标障碍物。实际上达到甚至超过目标检测+可行驶区域检测的效果,作为环境感知冗余的方法<br>

工作车速:0~30km/h;<br>环境要求:<br>光线在10~100000 lux, 实时雨量不高于小雨、实时雪量不高于小雪,能见度不低于200米

环视感知检测_FreeSpace

目标类型:<br>背景、可行驶区域、行人、车辆、道路、围墙护栏 、路沿、灌木<br>对于限高杆和悬挂物,需能够进行探测,并指出其可行驶区域

检测范围:<br>Freespace:探测车身周围前后20m,左右10m范围内的区域(从摄像头位置算起)

以自车坐标系构造格栅。输出格栅内每个网格点(Free Space点)的类型和位置信息,输出后轴中心在格栅中的位置信息;<br>提供后处理模块,提供车辆周围freespace的边界

FreeSpace点置信度:<br>明确可以被采纳为可信Free Space点的置信度阈值。<br>对于障碍物存在部分遮挡、不同的天气环境、不同的光线环境,支持通过置信概率以及置信度阈值来判断当前环境是否支持Free Space相关功能

FreeSpace点坐标:<br>车体坐标系中的坐标<br>图像坐标系中的坐标<br>提供车辆周围freespace的边界。使用最多1536个点描述

增加图像Depth信息,提升对于道闸等悬空杆的判断

环视感知指标_FreeSpace

检测频率≥10Hz;<br>从摄像头一帧影像输入到检测结果输出的延迟不高于100ms

召回率(Recall) >97%(待定)

准确率(Precision)>97%

平均类别识别准确率>90%

相对距离0m~5m以内: 边界平均距离误差10cm以内;<br>相对距离5m~10m以内:<br>边界平均距离误差:<10%;最大误差:<20%<br>相对距离10m~15m之间:<br>边界平均距离误差:<15%;最大误差:<25%<br>相对距离15m~20m之间:<br>边界平均距离误差:<20%;最大误差:<30%

不可通行区域检测稳定性概率>95%(待确认)

mIOU<br>光照良好(≥ 50Lux)条件:<br>5米以内:≥ 95%;<br>5~10米:≥ 90%<br>低照度(10 Lux ~ 50Lux)条件:<br>5米以内:≥ 90%;<br>5~10米:≥ 85%

环视感知车道线检测环境要求

待建图定位后续确认<br>

为了规划安全合理的路径,需要探测行驶道路上的车道线,明确可行驶的车道,同时,也需要基于车道线信息,定位车辆位置。<br>工作车速:0~60km/h<br>环境要求:<br>光线在10~100000 lux, 实时雨量不高于小雨、实时雪量不高于小雪,能见度不低于200米<br>车道类型:实线、虚线、双线、路沿、履带线(见下图)<br>车道线颜色: 白、黄、红/橙、蓝及其他<br>车道宽度:2.6 - 4.6m<br>车道线宽度:10-45cm<br>检测范围:<br>对于环视摄像头,识别自车前后至少20米的车道线<br>

车道线<br>

Line ID:<br>0: 本车道左侧车道线;<br>1:本车道右侧车道线;<br>2:左侧相邻车道最外侧车道线;<br>3:右侧相邻车道最外侧车道线<br>

车道线双线分类:<br>1. 单线,实线<br>2. 单线,虚线<br>3. 双线,实-实<br>4. 双线,实-虚<br>5. 双线,虚-虚<br>6. 双线,虚-实<br>7.未知

host lane 车道线类型准确率>90% (补充识别车道线类型距离)<br>

置信值: 0~100

Line positions ( equations )<br>曲线方程<br>(具体见下图车道线方程示意图)<br>至少满足车道线二次多项式方程(y = a0 + a1*x + a2*x^2);当然也可以按三次多项式方程(y = a0 + a1*x + a2*x^2 + a3*x^3)<br>车道线横向位置误差精度 ≤ ±6cm;<br>航向角(heading angle)<3度时,精度<(0.2度,0.02*X)<br>3度<航向角<7度时,精度<0.1*X<br>车道线方程示意图<br>

子主题

同步时间戳: 精确到毫秒;<br>基于车身高精度全局时间戳信息

车道线颜色:<br>1. 白色<br>2. 黄色<br>3. 蓝色<br>4. 未知<br>

车道线颜色准确率>90%

车位线

在泊车过程中,后视鱼眼实时感知车位线,测试结果用于环视车位角点进行校正,提升泊车精度。<br>

环视感知指标

车道线

更新周期≤30ms;<br>检测结果更新频率<br>

检测频率≥20Hz;<br>从摄像头一帧影像输入到检测结果输出的延迟不高于50ms

检测指标: 正常场景(光照值 ≥ 50Lux) <br>检测成功率 ≥ 98%;误检率 ≤ 2%<br>低照度场景(10Lux ≤ 光照值 <50Lux) <br>检测成功率 ≥ 85%;误检率 ≤ 5 %

融合后处理算法需求

在停车位检测和障碍物检测中,系统具备多源信息融合的能力,充分利用多传感器数据,为规划控制提供更为准确稳定的车位和障碍物信息。多传感器融合算法的硬件资源需求不超过整体资源的10%。融合后处理包括超声波雷达信息,在2#J3上完成

整体融合后处理输入要求

融合输入包括以下内容:<br>定位(位置、姿态);<br>超声波感知;<br>停车位视觉感知;<br>障碍物视觉感知;<br>FreeSpace视觉感知

车位后处理需求<br>

系统激活后,在泊入功能时,系统通过安装在车位左右两侧的超声波传感器和环视摄像头对停车位进行检测,通过多传感器融合算法,识别可泊入的车位。具体需求如下:<br>工作车速:0~30km/h<br>空车位识别率:线车位识别率达到95%以上<br>

车位检测,融合鱼眼原图障碍物检测、鱼眼freespace、鱼眼IPM图车位检测,鱼眼IPM图Pasing信息以及超声波的检测结果,最终输出车位相关信息<br>

车位类型输出:<br>水平车位、垂直车位、斜向车位(30°/45°/60°);<br>区分左右停车位<br>对于斜列式车位,需要输出车位的角度

停车位状态:空/非空判断;<br>结合可行驶区域检测(Free space)、超声波结果、原图感知,功能判断停车位状态;<br>基于车辆尺寸与车位尺寸判断是否可使用;<br>基于车位内障碍物判断是否车位可使用

停车位角点坐标:车体坐标系中的坐标;<br>需要在整个AVP过程中(从开始巡航到完成泊车过程),实时对车位进行检测和跟踪,输出停车位四个车位角点在车位坐标系下的坐标

停车位角点坐标:图像坐标系中的坐标;<br>需要在整个AVP过程中(从开始巡航到完成泊车过程),实时对车位进行检测和跟踪,输出停车位四个车位角点在图像坐标系下的坐标

传感器名称ID:<br>区分前视、前后左右环视、拼接图、超声波具体哪个输入检测到的车位

车位后处理指标需求

召回率(Recall)>95%<br>

准确率(Precision)>95%

寻车位过程中车位稳定跟踪概率>95%;<br>在一定范围方差范围内的稳定跟踪率;

泊车过程中车位稳定跟踪概率>95%

停车位坐标平均测距精度:10cm(≤3m);20cm(3~5m);(80%的ODD场景要求)<br>与环视摄像头距离:将直线距离投影到水平地面的距离

停车位编号(ID)精度:<br>寻车位阶段,停车位编号稳定跟踪准确率:>95%<br>泊入车位阶段,停车位编号稳定跟踪准确率:>95%

停车位类型精度:<br>水平、垂直、斜列式分类准确率:>95%<br>斜列式车位角度识别准确率:>95%<br>

停车位状态精度:<br>基于车位尺寸进行分类准确率(不可泊入的尺寸明确为:长度小于车长,宽度小于带后视镜的车宽)>98%<br>基于障碍物占用情况进行分类准确率(小型障碍物如地锁锥桶完全在车位线范围内的认为不可泊入,大型障碍物如车辆侵入车位线的认为不可泊入)>98%

障碍物后处理需求<br>

利用基于环视摄像头、前视摄像头、超声波雷达的多传感器数据融合算法,检测车辆周围全视野内的物体,保障障碍物输出的时延低、精度高、位置跳变小和分类准确率好。<br>工作车速:0~30km/h;<br>目标类型:行人、骑行者、车辆、地锁、锥桶/禁停牌等<br>检测范围:车辆前向20m内、后向20m内,车身左右各10m内

目标ID: 目标消失或遮挡或截断时,需保持近1秒的跟踪,且跟踪ID保持唯一<br>

融合目标类型:<br>0:未知;<br>1:锥桶、禁停牌、警示柱;<br>2:行人;<br>3:骑行者; <br>4:地锁;<br>5:车辆<br>6:停车位<br>7~255:预留;<br>

支持对静止状态障碍物进行跟踪,可以对连续出现在相邻多帧图像中的静止状态障碍物进行跟踪,可以对10米范围内的静止状态障碍物进行记忆。<br>支持对检测结果进行平滑滤波

目标置信度:0-99;<br>明确可以被采纳为可信障碍物的置信度阈值<br>对于障碍物存在部分遮挡、不同的天气环境、不同的光线环境,支持通过置信概率以及置信度阈值来判断当前环境是否支持障碍物检测

目标位置坐标:<br>车体坐标系中的坐标<br>图像坐标系中的坐标<br>需要在整个AVP过程中(从开始巡航到完成泊车过程),实时对障碍物进行检测和跟踪,输出障碍物若干个接地点在车位坐标系下的坐标<br>

传感器ID:输出感知结果所属摄像头;区分前后左右环视、拼接图、超声波具体哪路图像输入检测到的障碍物<br>

障碍物ID:支持对运动状态障碍物进行跟踪,可以对连续出现在相邻多帧图像中的运动状态障碍物进行跟踪

障碍物后处理指标需求<br>

相对距离位置坐标(Dx, Dy)<br>相对距离0m~5m以内: 10cm以内;<br>相对距离5m~10m以内:<br>平均误差:<10%;最大误差:<20%<br>相对距离10m~15m之间:<br>平均误差:<15%;最大误差:<25%<br>相对距离15m~20m之间:<br>平均误差:<20%;最大误差:<30%

目标宽度:平均误差:<15%;最大误差:<30%<br>目标高度:平均误差:<15%;最大误差:<30%(高度待定)<br>

准确率Precision:<br>光照良好(≥ 50Lux)条件<br>纵向10米以内:≥ 96% ; 纵向10~20米:≥ 92%<br>低照度(10 Lux ~ 50Lux)条件<br>纵向10米以内:≥ 92%; 纵向10~20米:≥ 88%<br>目标物(行人、骑行者、车辆)的相对速度低于30km/h, 且遮挡/截断面积不超过可视面积的40%;<br>小目标物(地锁、锥桶和停车牌等)无遮挡和截断<br>

召回率Recall:<br>光照良好(≥ 50Lux)条件<br>纵向6米以内:≥ 96%;纵向6~10米:≥ 92%<br>低照度(10 Lux ~ 50Lux)条件<br>纵向6米以内:≥ 92%; 纵向6~10米:≥ 88%

静态障碍物,障碍物稳定跟踪概率>95%

动态障碍物,障碍物稳定跟踪概率>90%

障碍物编号(ID)精度:<br>静态障碍物,障碍物编号稳定跟踪准确率: >95%;<br>动态障碍物,障碍物编号稳定跟踪准确率: >90%

障碍物运动状态精度:运动静止>90%(人和车)

障碍物相对地面运动方向检测误差<45度(90%

行人测速:0-15kph <br>总体:1.5m/s(Average Error),3m/s(90%)(补充具体含义)<br>速度:0-50kph<br>总体:1.5m/s(Average Error),3m/s(90%)

车辆后处理指标需求<br>

车辆目标横纵向距离,横纵向距离标准差;<br>车辆目标横纵向速度(包括相对速度和绝对速度),横纵向速度标准差<±10%;<br>车辆目标横纵向加速度

车辆目标长宽高,和长宽高的标准差

目标车辆 heading angle朝向角和朝向角标准差

目标车辆3D框角点输出

目标运动状态:<br>

1. 静止(相当于stationary)<br>2. 停止基于车辆历史运动状态(相当于stopped)<br>3. 运动<br>4. 未知<br>5. 无效

目标车辆有效标志:1.有效(stable);2.无效(unstable)

车辆是否为新生成的目标:1.本周期新生成目标;2.先前周期跟踪目标

目标车辆是否为预测车辆

目标车辆是否为预测车辆:<br>1.预测的目标;<br>2.测量到的目标ux, 实时雨量不高于小雨、实时雪量不高于小雪,能见度不低于200米<br>

Freespace后处理需求

目标类型:<br>背景、可行驶区域、行人、车辆、道路、围墙护栏 、路沿、灌木<br>对于限高杆和悬挂物,需能够进行探测,并指出其可行驶区域

检测范围:<br>Freespace:探测车身周围前后20m,左右10m范围内的区域(从摄像头位置算起)

以自车坐标系构造格栅。输出格栅内每个网格点(Free Space点)的类型和位置信息,输出后轴中心在格栅中的位置信息;<br>提供后处理模块,提供车辆周围freespace的边界

FreeSpace点置信度:<br>明确可以被采纳为可信Free Space点的置信度阈值。<br>对于障碍物存在部分遮挡、不同的天气环境、不同的光线环境,支持通过置信概率以及置信度阈值来判断当前环境是否支持Free Space相关功能

FreeSpace点坐标:<br>车体坐标系中的坐标<br>图像坐标系中的坐标<br>提供车辆周围freespace的边界。使用最多1536个点描述;

增加图像Depth信息,提升对于道闸等悬空杆的判断

Freespace后处理指标需求

检测频率≥10Hz;<br>从摄像头一帧影像输入到检测结果输出的延迟不高于100ms

召回率(Recall) >97%(待定)

准确率(Precision)>97%

平均类别识别准确率>90%

相对距离0m~5m以内: 边界平均距离误差10cm以内;<br>相对距离5m~10m以内:<br>边界平均距离误差:<10%;最大误差:<20%<br>相对距离10m~15m之间:<br>边界平均距离误差:<15%;最大误差:<25%<br>相对距离15m~20m之间:<br>边界平均距离误差:<20%;最大误差:<30%

不可通行区域检测稳定性概率>95%<br>

mIOU<br>光照良好(≥ 50Lux)条件:<br>5米以内:≥ 95%;<br>5~10米:≥ 90%<br>低照度(10 Lux ~ 50Lux)条件:<br>5米以内:≥ 90%;<br>5~10米:≥ 85%

定位算法需求

定位环境要求

工作车速:0~20km/h<br>光照强度 ≥ 10lux<br>室内:墙面无强反光及镜面反射;如:镜面墙(面积>1㎡)<br>室外:1) 建筑物等变化频率较小且纹理相对丰富的物体,在视野中的比例大于30%;2) 天空(白云)、车辆、行人等变化频率较高的物体,在视野内的比例小于30%;<br><br>对于短距离的非空阔区域固定路径或流动车位记忆泊车,可以利用环视系统的多路摄像头,进行实时定位和建图。<br>

定位输入需求

输入<br>

前视图像<br>

环视图像

原图和IPM图<br>

IMU

6轴<br>

GPS

GPS信号和最后一次有效信息<br>

轮速计

车身信号

定位输出需求

输出<br>

时间戳

定位置信度

给出定位置信概率以及置信度阈值,用于判断定位的可靠性<br>对于障碍物存在部分遮挡、不同的天气环境、不同的光线环境,支持通过置信概率以及置信度阈值来判断当前环境是否支持定位相关功能。

位姿<br>

位置(x,y,z)<br>速度(vx, vy, vz)<br>加速度(ax, ay, az)<br>姿态(roll,pitch,yaw)<br>角速度(wx, wy, wz)

定位算法需求<br>

通过前视和环视原图,提取特征点信息

通过地图引擎读取地图数据,并且结合感知结果、特征点信息、GPS定位信息进行定位初始化

结合IMU和车身数据,进行定位融合计算,输出最终定位结果

定位性能指标

初始化时间:≤2s

初始定位:起点偏差路径允许的纵向范围偏差在±5m范围内;<br>重定位:在轨迹内任意位置均可

起点偏差路径允许的横向范围≥±3m

起点偏差初始允许的角度范围≥±15°

初始纵向定位误差≤20cm

初始横向定位误差≤20cm

初始高度定位误差≤50cm

初始定位角度偏差≤5°

行车纵向定位误差≤±20cm

行车横向定位误差≤±15cm

行车高度定位误差≤±25cm

行车定位角度偏差≤±1.5°

泊车纵向定位误差≤±10cm(待确定)<br>

泊车横向定位误差≤±10cm(待确定)

泊车定位角度偏差≤±3°(待确定)

初始定位:在建图轨迹内车辆连续运动<5m,起始点定位成功率 > 90% (待确定)

建图算法需求

建图环境需求

工作车速:0~20km/h<br>环境要求:<br>光照强度 ≥ 10lux<br>室内:墙面无强反光及镜面反射;如:镜面墙(面积>1㎡)<br>室外:1) 建筑物等变化频率较小且纹理相对丰富的物体,在视野中的比例大于30%;2) 天空(白云)、车辆、行人等变化频率较高的物体,在视野内的比例小于30%;

建图需求

GPS位置关联

当用户开始建图时,关联最后一次有效的GPS信息;并作设置为地理围栏,作为下次开启的判断前置条件,地理围栏半径50m(TBD)

开启条件

开始条件:用户主动触发开始

开始条件:多次经过相同地点,并且结合导航信息识别为停车场,开启建图;

结束条件

用户主动结束或者挂P挡并拉起EPB,作为建图结束

地图要素

特征点地图

前视和环视提取图片中的特征点信息

语义点云地图

道路边界<br>

地面标识

车道线

车位线

车位(待确定-是否增加)<br>

阻车器(待定)

地说(待定)

子主题<br>

高精矢量地图

道路几何

道路拓扑(待定)

相对高度(仅区分处在哪一层,有上下层信息)

道路长度

车道几何<br>

车道线类型

车道宽度(待定)

车道拓扑(待定)

车道方向(待定)

停车位

地面箭头

减速带<br>

水泥柱

防撞条<br>

转向标志<br>

地锁<br>

建图时用户驾驶轨迹线信息,给下游规划控制做参考行驶轨迹线

建图输入输出

输入<br>

前视图像<br>环视图像<br>IMU<br>轮速计<br>GPS

输出

时间戳<br>静态目标ID<br>类型:减速带/车轮定位器/地锁/地面标识/道闸/人行横道/转向标志/立柱<br>坐标:静态要素坐标(车身坐标系,后轴中心为原点,前X左Y)<br>

建图性能指标

记忆路径长度≤1km;<br>路径可支持固定车位或者沿途车位的记忆泊车

建图路线最短支持5m,在ODD范围内,成功率≥95%

建图时间1km<1min(用户完成驾驶后等待时间,不包括驾驶过程)<br>

建图大小<50M/100m<br>起始点大:100M (TBD);<br>后续每增加100m大小:15M(TBD)

外部环境

降雨量&降雪

降雨量:24小时内小于10mm;<br>降雪量:24小时内小于2.5mm;<br>雨刮摆动频率在最低档位<br>能见度>100m (晴天、阴天、小雨、小雪、轻度雾霾)<br>TBD,依据实际场景测试

光照环境<br>

1)建图与使用中光源的位置分布变化不能太大,例如:不能在学习中采用自然光,而使用中采用灯光;室内灯光是同一套,允许灯光有一定比例≤10%的损坏<br>2) 图像中能清晰显示标志物(建筑物等)的轮廓和纹理:光照强度大于 30lux(保证图像的噪声较小;照度较低时,图像噪声较大)<br>3) 均匀光照/顺光/轻度逆光

停车场

地下停车场光照稳定<br>

地上停车场<br>

不包括路边车位

停车楼

非封闭,容易受自然光照射影响

建图坡度支持<10%(6°)

建图坡度支持(跨层)<15%(8°)

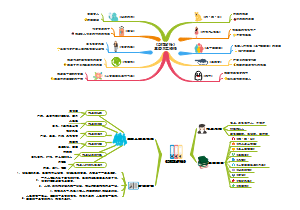

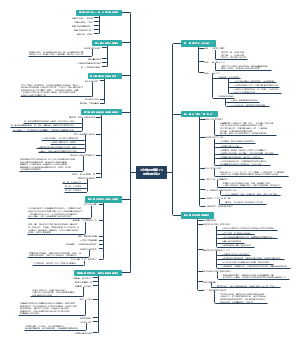

规控算法需求

路径规划需求

全局路径规划需求

全局路径是基于学习记忆到的路径进行优化,形成一系列的曲线和直线的组合,并且曲线和直线之间的曲率需要为平滑不能突变,适合于车辆横向控制。 路径规划算法的复杂度需要满足规划一次路径的时间小于100ms。路径算法需要进行边界碰撞检查,转弯半径界限检查等。

局部路径规划需求

局部路径规划,在车辆正常自动行驶期间,车辆需能够进行局部路径规划,并满足以下要求: a)应能避免发生碰撞。 b)应能遵守停车场内的交通规则。 c)应能将车辆保持在可行驶区域内。 d)应能将车辆速度保持在停车场规定的限速范围内,或其自身设定的限速范围内(以较小者为准)。 在车辆自动行驶期间遇到移动的车辆或行人,车辆需能够与其他道路使用者保持至少40cm的距离(从车辆的最外边缘测量,不包括侧视镜/装置)。

局部路径设计

车辆偏离全局路径

当车辆偏离全局路径时,需要规划局部路径,使车辆回到全局路径上

车辆在全局路径上遇到障碍物

当障碍物出现在全局路径上,需要规划局部路径避开障碍物,并且回到全局路径上

前进和后退

局部路径是一系列的曲线和直线的组合, 并且曲线和直线之间的曲率平滑不能突变,适合于车辆横向控制。

决策规划要求

输入要求

起点-终点

障碍物

类型、位置

车位

车位角点