导图社区 统计分析与机器学习

- 72

- 6

- 0

- 举报

统计分析与机器学习

统计分析与机器学习(精简版)思维导图:技巧:贝叶斯学习(Bayesian learning)、核方法(Kernel method)、模型评估与模型选择,正则化与交叉验证,泛化能力 generalization ability等等

编辑于2022-03-31 14:16:20- 雅思政治阅读核心词汇(中文释义)

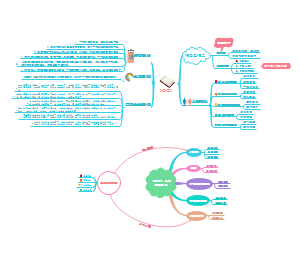

这是一篇关于雅思政治阅读核心词汇(中文释义)的思维导图,主要内容包括:一、政治体系与制度,二、政治组织与机构,三、政治人物与角色,四、政治活动与行为,五、政治现象与问题,六、法律与权利,七、政治经济关联词汇,八、政治文化与意识形态。

- IELTS Economic Reading Vocabul

这是一篇关于IELTS Economic Reading Vocabul的思维导图,主要内容包括:1. Basic Economic Concepts,2. Market and Trade,3. Economic Policies and Regulation,4. Economic Phenomena and Trends,5. Impacts and Consequences。

- 雅思经济类阅读常用单词

这是一篇关于雅思经济类阅读常用单词的思维导图,主要内容包括:一、经济基本概念,二、市场与贸易,三、经济政策与调控,四、经济现象与趋势,五、影响与后果。

统计分析与机器学习

社区模板帮助中心,点此进入>>

- 雅思政治阅读核心词汇(中文释义)

这是一篇关于雅思政治阅读核心词汇(中文释义)的思维导图,主要内容包括:一、政治体系与制度,二、政治组织与机构,三、政治人物与角色,四、政治活动与行为,五、政治现象与问题,六、法律与权利,七、政治经济关联词汇,八、政治文化与意识形态。

- IELTS Economic Reading Vocabul

这是一篇关于IELTS Economic Reading Vocabul的思维导图,主要内容包括:1. Basic Economic Concepts,2. Market and Trade,3. Economic Policies and Regulation,4. Economic Phenomena and Trends,5. Impacts and Consequences。

- 雅思经济类阅读常用单词

这是一篇关于雅思经济类阅读常用单词的思维导图,主要内容包括:一、经济基本概念,二、市场与贸易,三、经济政策与调控,四、经济现象与趋势,五、影响与后果。

- 相似推荐

- 大纲

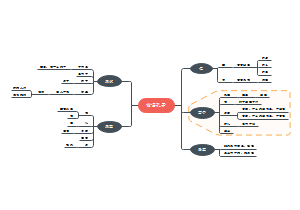

统计分析与机器学习(精简版)

统计学习

算法

在线学习(online learning)

批量学习(batch learning)

技巧

贝叶斯学习(Bayesian learning)

核方法(Kernel method)

使用核函数表示和学习非线性模型,将线性模型学习方法扩展到非线性模型的学习 不显式地定义输入空间到特征空间的映射,而是直接定义核函数,即映射之后在特征空间的内积 假设x1,x2是输入空间的任意两个实例,内积为<x1, x2>,输入空间到特征空间的映射为φ, 核方法在输入空间中定义核函数 K(x1, x2),使其满足 K(x1, x2) = < φ(x1), φ(x2)>

三要素

模型

决策函数的集合

参数空间

条件概率的集合

参数空间

策略

损失函数:一次预测的好坏

风险函数:平均意义下模型预测的好坏

0-1损失函数 0-1 loss function

平方损失函数 quadratic loss function

绝对损失函数 absolute loss function

对数损失函数 logarithmic loss function 或对数似然损失函数 loglikelihood loss function

损失函数的期望

风险函数 risk function 期望损失 expected loss 由P(x,y)可以直接求出P(x|y),但不知道,

经验风险 empirical risk 经验损失 empirical loss

经验风险最小化与结构风险最小化

经验风险最小化最优模型

当样本容量很小时,经验风险最小化学习的效果未必很好,会产生“过拟合over-fitting”

结构风险最小化 structure risk minimization,为防止过拟合提出的策略,等价于正则化(regularization),加入正则化项regularizer,或罚项 penalty term:

求最优模型就是求解最优化问题:

算法

如果最优化问题有显式的解析式,算法比较简单 但通常解析式不存在,就需要数值计算的方法

模型评估与模型选择

训练误差,训练数据集的平均损失

测试误差,测试数据集的平均损失

损失函数是0-1 损失时

测试数据集的准确率

过拟合与模型选择

假设给定训练数据集

经验风险最小

正则化与交叉验证

正则化一般形式

回归问题中

交叉验证

训练集 training set: 用于训练模型

验证集 validation set: 用于模型选择

测试集 test set: 用于最终对学习方法的评估

简单交叉验证

S折交叉验证

留一交叉验证

泛化能力 generalization ability

泛化误差 generalization error

泛化误差上界

比较学习方法的泛化能力------比较泛化误差上界

性质:样本容量增加,泛化误差趋于0,假设空间容量越大, 泛化误差越大

二分类问题

期望风险和经验风险

经验风险最小化函数

泛化能力

定理:泛化误差上界,二分类问题,当假设空间是有限个函数的结合 ,

对任意一个函数f, 至少以概率1-δ,以下不等式成立:

生成模型与判别模型

监督学习的目的就是学习一个模型:

决策函数

条件概率分布

生成方法Generative approach 对应生成模型:generative model

朴素贝叶斯法和隐马尔科夫模型

分类问题

二分类评价指标 TP true positive FN false negative FP false positive TN true negative

精确率

召回率

F1值

标注问题

标注:tagging, 结构预测:structure prediction

输入:观测序列, 输出:标记序列或状态序列

学习和标注两个过程

训练集

观测序列

输出标记序列

模型:条件概率分布

回归问题

回归学习最常用的损失函数是平方损失函数,在此情况下,回归问题可以由 著名的最小二乘法(least squares)求解。

方法

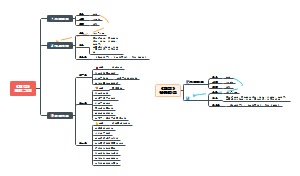

supervised learning 监督学习

基础关键词

训练数据 training data

模型 model

假设空间 hypothesis

评价准则 evaluation criterion

策略 strategy

算法 algorithm

Instance

feature vector

feature space

输入实例x的特征向量

x(i)与xi 不同,后者表示多个输入变量中的第i个

训练集

输入变量和输出变量: 分类问题、回归问题、标注问题

联合概率分布

假设输入与输出的随机变量X和Y遵循联合概率分布P(X,Y)

P(X,Y)为分布函数或分布密度函数

对于学习系统来说,联合概率分布是未知的,

训练数据和测试数据被看作是依联合概率分布P(X,Y)独立同分布产生的。

假设空间

监督学习目的是学习一个由输入到输出的映射,称为模型

模式的集合就是假设空间(hypothesis space)

概率模型:条件概率分布P(Y|X), 决策函数:Y=f(X)

问题形式化

unspervised learning 半监督学习

训练集

条件概率分布

模型函数

少量标注数据,大量未标注数据 利用未标注数据的信息,辅助标注数据,进行监督学习 较低成本

Unsupervised learning 无监督学习

Reinforcement learning 强化学习

状态转移概率函数

奖励函数

策略π:给定状态下动作的函数

或者条件概率分布

状态价值函数

动作价值函数

方法

无模型(model-free)

基于策略(policy-based):求解最优策略π*

基于价值(value-based):求解最优价值函数

有模型(model-based)

通过学习马尔可夫决策过程的模型,包括转移概率函数和奖励函数

通过模型对环境的反馈进行预测

求解价值函数最大的策略π*

对象

Data :计算机及互联网上的各种数字、文字、图像、视频、音频数据以及它们的组合。 数据的基本假设是同类数据具有一定的统计规律性。

目的

用于对数据(特别是未知数据)进行预测和分析。

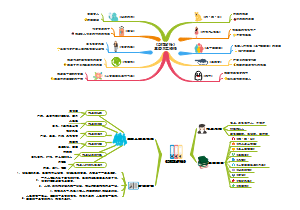

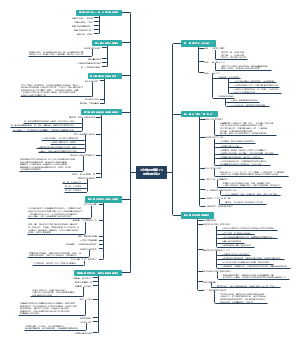

统计学习详细版本

方法

supervised learning 监督学习

基础关键词

训练数据 training data

模型 model

假设空间 hypothesis

评价准则 evaluation criterion

策略 strategy

算法 algorithm

Instance

feature vector

feature space

输入实例x的特征向量

x(i)与xi 不同,后者表示多个输入变量中的第i个

训练集

输入变量和输出变量: 分类问题、回归问题、标注问题

联合概率分布

假设输入与输出的随机变量X和Y遵循联合概率分布P(X,Y)

P(X,Y)为分布函数或分布密度函数

对于学习系统来说,联合概率分布是未知的,

训练数据和测试数据被看作是依联合概率分布P(X,Y)独立同分布产生的。

假设空间

监督学习目的是学习一个由输入到输出的映射,称为模型

模式的集合就是假设空间(hypothesis space)

概率模型:条件概率分布P(Y|X), 决策函数:Y=f(X)

问题形式化

unspervised learning 半监督学习

训练集

条件概率分布

模型函数

少量标注数据,大量未标注数据 利用未标注数据的信息,辅助标注数据,进行监督学习 较低成本

Unsupervised learning 无监督学习

Reinforcement learning 强化学习

状态转移概率函数

奖励函数

策略π:给定状态下动作的函数

或者条件概率分布

状态价值函数

动作价值函数

方法

无模型(model-free)

基于策略(policy-based):求解最优策略π*

基于价值(value-based):求解最优价值函数

有模型(model-based)

通过学习马尔可夫决策过程的模型,包括转移概率函数和奖励函数

通过模型对环境的反馈进行预测

求解价值函数最大的策略π*

算法

在线学习(online learning)

批量学习(batch learning)

技巧

贝叶斯学习(Bayesian learning)

核方法(Kernel method)

使用核函数表示和学习非线性模型,将线性模型学习方法扩展到非线性模型的学习 不显式地定义输入空间到特征空间的映射,而是直接定义核函数,即映射之后在特征空间的内积 假设x1,x2是输入空间的任意两个实例,内积为<x1, x2>,输入空间到特征空间的映射为φ, 核方法在输入空间中定义核函数 K(x1, x2),使其满足 K(x1, x2) = < φ(x1), φ(x2)>

三要素

模型

决策函数的集合

参数空间

条件概率的集合

参数空间

策略

损失函数:一次预测的好坏

风险函数:平均意义下模型预测的好坏

0-1损失函数 0-1 loss function

平方损失函数 quadratic loss function

绝对损失函数 absolute loss function

对数损失函数 logarithmic loss function 或对数似然损失函数 loglikelihood loss function

损失函数的期望

风险函数 risk function 期望损失 expected loss 由P(x,y)可以直接求出P(x|y),但不知道,

经验风险 empirical risk 经验损失 empirical loss

经验风险最小化与结构风险最小化

经验风险最小化最优模型

当样本容量很小时,经验风险最小化学习的效果未必很好,会产生“过拟合over-fitting”

结构风险最小化 structure risk minimization,为防止过拟合提出的策略,等价于正则化(regularization),加入正则化项regularizer,或罚项 penalty term:

求最优模型就是求解最优化问题:

算法

如果最优化问题有显式的解析式,算法比较简单 但通常解析式不存在,就需要数值计算的方法

模型评估与模型选择

训练误差,训练数据集的平均损失

测试误差,测试数据集的平均损失

损失函数是0-1 损失时

测试数据集的准确率

过拟合与模型选择

假设给定训练数据集

经验风险最小

正则化与交叉验证

正则化一般形式

回归问题中

交叉验证

训练集 training set: 用于训练模型

验证集 validation set: 用于模型选择

测试集 test set: 用于最终对学习方法的评估

简单交叉验证

S折交叉验证

留一交叉验证

泛化能力 generalization ability

泛化误差 generalization error

泛化误差上界

比较学习方法的泛化能力------比较泛化误差上界

性质:样本容量增加,泛化误差趋于0,假设空间容量越大, 泛化误差越大

二分类问题

期望风险和经验风险

经验风险最小化函数

泛化能力

定理:泛化误差上界,二分类问题,当假设空间是有限个函数的结合 ,

对任意一个函数f, 至少以概率1-δ,以下不等式成立:

生成模型与判别模型

监督学习的目的就是学习一个模型:

决策函数

条件概率分布

生成方法Generative approach 对应生成模型:generative model

朴素贝叶斯法和隐马尔科夫模型

分类问题

二分类评价指标 TP true positive FN false negative FP false positive TN true negative

精确率

召回率

F1值

标注问题

标注:tagging, 结构预测:structure prediction

输入:观测序列, 输出:标记序列或状态序列

学习和标注两个过程

训练集

观测序列

输出标记序列

模型:条件概率分布

回归问题

回归学习最常用的损失函数是平方损失函数,在此情况下,回归问题可以由 著名的最小二乘法(least squares)求解。