导图社区 中小学教师职业道德规范 第四章 课堂小结技能

- 39

- 0

- 0

- 举报

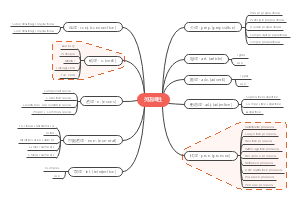

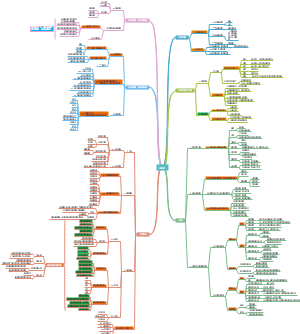

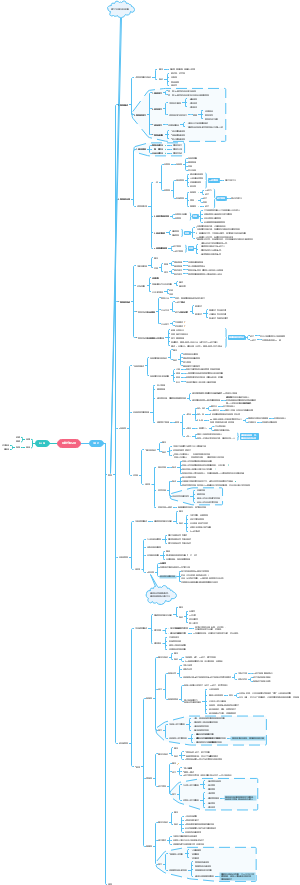

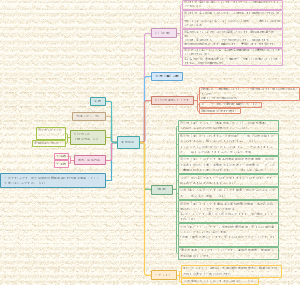

中小学教师职业道德规范 第四章 课堂小结技能

课堂小结是教师在一个教学内容结束或一节课的教学任务终了时,有目的、有计划地通过归纳总结、重复强调、实践等活动使学生对所学的新知识、新技能进行及时的巩固、概括、 运用,把新知识新技能纳入原有的认知结构,使学生形成新的完整的认知结构,并为以后的教学做好过渡的一类教学行为。

编辑于2022-06-06 20:46:50- 课堂

- 课堂小技能

- 中小学教师职业道德规范

- 相似推荐

- 大纲

第五章课堂小结技能

一、课堂小结的含义

课堂小结是教师在一个教学内容结束或一节课的教学任务终了时,有目的、有计划地通过归纳总结、重复强调、实践等活动使学生对所学的新知识、新技能进行及时的巩固、概括、 运用,把新知识新技能纳入原有的认知结构,使学生形成新的完整的认知结构,并为以后的教学做好过渡的一类教学行为。

课堂小结技能不仅应用于一节课的结束,一章知识的学习结束,也经常应用于相对独立 的教学阶段的结尾。

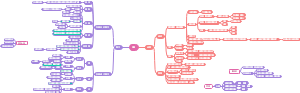

二、课堂小结的功能

1.条理化、系统化功能

2.巩固强化功能

3.激趣开智功能

4.教学过渡功能

三、课堂小结原则

(一)目的性原则

结课是为实现课时教学目标服务的。因此,教师必须以课时既定的教学目标为依据 来确定“结束”的实施方式和方法。课堂结束要紧扣教学目标、教学重点和知识结 构,针对学生的知识掌握情况以及课堂教学情境等采取恰当方式,把所学新知识及时 纳入学生已有的认知结构中。结课要及时精要,有利于学生回忆、检索和运用。 确定“结束”的实施方式和方法。课堂结束要紧扣教学目标、教学重点和知识结构,针对学 生的知识掌握情况以及课堂教学情境等采取恰当方式,把所学新知识及时纳入学生已有的认知结构中。结课要及时精要,有利于学生回忆、检索和运用。

(二)趣味性原则

充满情趣的结课能有效地激发学生的学习动机,使学生的身心得到放松,浓厚的兴趣 得以保持。根据小学生好奇、好动、好胜的特点,教师每讲一节内容都要设计出新颖 别致的结课形式,或者概括总结,或者提出问题,或者设置悬念,不能千篇一律而索 然无味。不管怎样结课,都要给学生以启发,以激起他们努力探索的积极性,要“点 而不透、含而不露、意味无穷”,因为任何的教学效果都以学生是否自愿参与,怎样 参与,参与多少的状况来决定的,所以课堂教学结束只有让学生积极参与,学生才会 感到快乐,效果才会显著。 课形式,或者概括总结,或者提出问题,或者设置悬念,不能千篇一律而索然无味。

(三)一致性原则

注意首尾呼应,使结课和导课脉络贯通。结课实际上就是对导课设疑的总结性问答, 或是导课思想内容的进一步延续和升华。如果导课精心设疑布阵,讲课和结课中却无 下文,或结课又是悬念顿生,另搞一套,则会使学生思路紊乱,难以集中精力进行探 索。只有前后一致,主线清晰,才是一节完美的课。

(四)多样性原则

结课的形式应多种多样,不同科目,不同课型需要选择不同的结课方式。例如,对 揭示概念的课型一般可采用画龙点睛、概括要点的结课形式;对法则、定律推广练习 一类的课型,可采用讨论、总结、归纳的结课形式;对巩固训练的范例课型,可采用 点拨方法、提示要点的结课形式。对不同年级的学生,要根据他们心理、生理的特点 选择不同的结束方式。低年级一般采用“启发谈话,回顾复述”的结课形式,高年级 一般采用“抽象概括、整理归纳”的结课方式;同时,还可以安排一定的学生实践活 动,如练习、口答和实验操作等。通过思维训练和实践活动,启发学生积极思维,培 养学生抽象能力、概括能力和口头与书面表达能力。 概念的课型一般可采用画龙点睛、概括要点的结课形式:对法则、定律推广练习一类的课 型,可采用讨论、总结、归纳的结课形式;对巩固训练的范例课型,可采用点拨方法、提示要点的结课形式。

(五)适时性原则

结课要严格控制时间,按时下课,既不可提前,也不可“拖堂”。由于计划不周 或组织不当,课堂教学节奏过快,给结课留的时间过多,学生无事可干,教师随心所 欲,生拉硬扯一些与本节课毫无关系的杂事来应付,既浪费宝贵的教学时间,也会冲 淡或干扰本课的主题,影响学习效果。学生最反感上课拖堂延点,下课铃一响,学生 的注意力就不集中了,此时继续讲课、结课都不会取得好效果。拖堂延点还会影响学 生下节课的学习情绪,形成恶性循环,得不偿失。不论是提前下课还是拖堂延点,都 是违反课堂教学结束基本要求的不正确做法,教师应该避免这两种情况的发生。

四、结课的一般过程

在结束一节课或一个课题时,一般需经过以下几个环节:

(一)简单回忆。对整个教学内容进行标题式回顾,是使用最普遍的环节

(二)提示要点。指出教学内容的重点、难点、关键点,必要时可做进一步的说明, 进行巩固和强化。用比较、提问的方法

(三)巩固练习 提出问题或采用其他形式检验学习结果。

(四)拓展延伸。有时为了拓展学生的思路,开阔学生的视野,或把前后知识联系起 来,形成系统,需要在结课时对教学内容进行必要的扩展延伸。

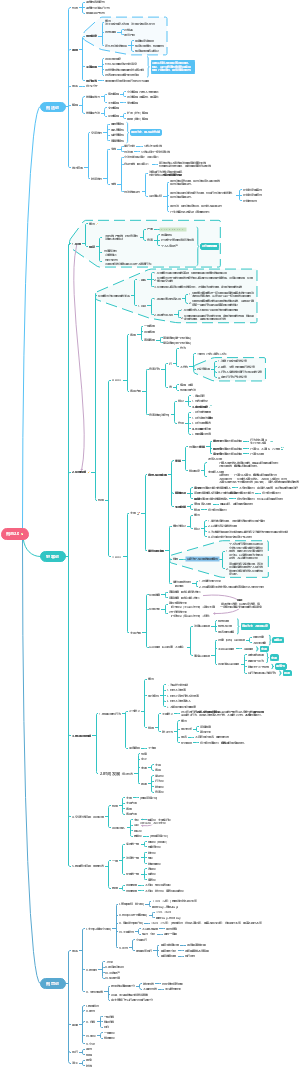

五、教学结课的类型

(1)认知型结束(封闭型结束)

1.总结归纳。

用总结性的语言把一节课、一章书的内容在最后进行归纳,这个工作可以由学生单独完成,也可引导学生集体讨论完成。

2.区别对比。

在一个教学内容结束时,将教学中一些容易混淆的知识加以区分和对比,能帮助学生加深记忆和理解。

3.竞赛活动。

对于一些比较枯燥无味的内容或实践性较强的内容,在结束时可以用稍长一点的时间进行有关内容的竞赛活动,使学生在活动的过程中巩固知识。

4.实践应用。

用向学生提出问题的形式,也可用实践操作的形式,要求学生利用当堂所学知识解决生活、生产、社会实践中的问题,达到学以致用、活学活用的目的。

5.绘简图或模式图。

在一节课结束之时,可通过画图让学生想像、回忆所学内容,这样 不仅帮助学生学会利用图形来提高理解记忆能力,而且是利用学生的空间智能进行学习。

(2)开放型结束。

1.悬念存疑。

教学中上下章节之间的联系有时非常密切,在前一部分完成时可以把下一内容的重点或学生感兴趣的内容提示出来,然后告诉学生“欲知后事如何,请听下回分解。” 也可顺着本节课的总结提出几个问题让学生思考,这样承上启下的结束,往往能激发学生浓 厚的兴趣。

2.故事遗趣。

故事最好由班上的学生自己准备,让他们自己来讲,促使学生课后多读学科发展史上的有趣故事。拓展其知识面。

3.拓展延伸。

指将教学内容向社会实际、生活实际、学科发展前沿开拓延伸,以便学生了解学习的价值,引发学习的间接兴趣。

六、课堂小结的几种常见形式

(一)归纳总结式

归纳式小结,是指教师在课堂结束阶段,将本课堂所教的知识整理,归纳,使之条理化, 系统化,以达到巩固,掌握知识的一种方法。

例如有位历史在讲《第一次世界大战》后的结语是:“这一节课可以简单的小结为一, 二,三,四,五。一个原因,两个侵略集团,三条战线,四大战役,五个年头。”

(二)比较式结课

比较式结束语是教师引导学生通过对教学内容采用辨析、比较、讨论等方式结束课堂教 学的一种方法,意在加深和扩展学生对教学内容的理解,提高学生的鉴别能力,促使学生对 所学知识举一反三,触类旁通,培养学生思维的广阔性和灵活性。

例如有位语文老师在讲授《秋色赋》时,在落实本课的基本要求后,在结束课时将欧阳 修的《秋声赋》和毛泽东的《沁园春长沙》一同发给大家,引导学生比较,思考和讨论。

(三)悬念式

教师通过巧设疑掌,对教学内容留有余地,使学生达到“欲知后事如何且听下回分解” 思维程度,欲罢不能,非读不可,激发学生去思维探索,以激发学生进一步获取知识的欲望, 架起新旧知识的桥梁。密切新旧知识间的联系,这就是悬念法。

在讲完“种子的结构”和“种子的成分”后,教师根据下一课“种子的萌发”的 内容,使用启下法结尾:“同学们,通过学习,我们知道了种子的结构和种子的成 分。一粒很小的种子,播种到土壤中,有的竟能长成参天大树,有的并不一定能发 芽,你说怪不怪?这是为什么呢?要知道这一点,下一节课再给同学们讲解。”

(四)高潮式

在课堂结尾时有意制造一个小高潮,使其异峰突起,一遍加深学生对知识的印象,这种结课 方式即为高潮式。

如讲授“质数”时,一位教师在课尾说:我国著名数学家陈景润研究哥德巴赫猜想, 在国际上享有很高的声誉。现在我们根据已学知识也来做一道“哥德巴赫猜想”题。 出示24= ( ) o请找出不同的三组质数,使它们的和分别是24。学生积极动脑,争着 发言,结课前形成一个小高潮。

(五)练习式

教师通过让学生做练习,作业的方式结束课堂教学。这是最简单最常用的一种结课方 法,它主要包括总结巩固和布置家庭作业两个内容

如一位教师在教“最大公约数” 一课时设计了这样一道趣味习题结束课堂教学: “猜电话号码游戏:王老师家的电话号码是一个七位数,从高位到低位依次是:①最 小的合数;②最小的自然数;③最小的既是奇数又是素数;④既是偶数又是素数;⑤ 只有三个约数的偶数;⑥既是5的倍数,又是5的约数;⑦6和12的最大公约数。你 能说出王老师家的电话号码吗?

(六)回味式

即教师用浓郁的色彩,含蓄的艺术手段来结束一堂课,使学生达到“言已尽而意无穷”之 效果,课后引起学生咀嚼回味,展开丰富想象。

《茶花赋》一文,老师在结束课时,出示了一副含露乍开的童子面茶花挂图,其用意有二: 一是让学生顺着文章脉络理解有关语句,二是让鲜艳绚丽的童子面茶花的形象印在学生的心 上。用美好的形象,引导学生具体体会作者对新生的社会主义伟大祖国的无限热爱与由衷赞 美,理解文章的精髓;用这样美好的形象在学生心田撒播热爱祖国的种子,激发热爱社会主 义的深情。这样能激起学生回味的结课含蓄隽永、耐人寻味。

(七)游戏法

游戏法是一种把练习内容寓于游戏之中的结束课堂教学的方法。小学生往往对大 量的、枯燥的练采用游戏法结课能帮助他们从厌倦的情绪中解放出来,唤起他们主动 参与练习的激情,收到事半功倍的效果,并从中体验成功的喜悦,唤起儿童再一次追 求成功的心向。

小学数学〃倍的认识〃一课,一位教师在结束时,设计了〃动脑筋离开教室〃的游戏。 师生总结全课后,表扬本课最突出的三名同学,下课时要让他们手拉手先走出教室。 然后提出:其余同学离开教室时,动脑筋想一想,怎样走.,能让大家一眼就看出剩下 的人数是他们的几倍。(全班人数是3的倍数)经过一阵叽叽喳喳的讨论,大家认识 到,以被表扬的三个同学为一倍量,思考剩下的学生还有几个3,即是3的几倍。下 课铃响了,同学们纷纷三人一组手牵着手快乐地离开了教室C 这样的结尾,自然、巧妙、不落俗套,寓知识的巩固、思维的发展于轻松的游戏 之中,悄然之间丰富了学生〃倍〃的概念表象,深化了对于〃倍〃的理解。习缺乏兴趣,甚 至产生厌倦心理,

(八)提问法

提问法是在课堂结束时,教师围绕着教学内容进行口头提问,让学生回答。然后 教师或其他学生再根据回答的情况进行必要的修正和补充的方法。需要指出的是,口 头提问必须针对要点、难点和关键点,切忌走题。

《平行四边形面积的计算》一课的 教学结束。 《平行四边形面积的计算》一课的教学结束。 师:今天我们学习了平行四边形面积的计算,我们是用什么方法求出它的面积公 式的?生:先把平行四边形变成长方形,再根据长方形的面积公式来求平行四边形面 积公式。师:这种方法我们叫什么呢? 生:割补法。 师:我们经常会遇到新的图形,想求它的面积,就可以用这种〃割〃、“补〃的方法, 把未知面积公式的图形转化成我们知道面积公式的图形,来求它的面积公式。以后学 习三角形、梯形的面积公式也可用这种方法来推导。学习处于被动状态。

(九)回应法

回应法是指教学结束与起始相呼应,使整个教学过程前后照应的方法。回应的内容包 括开头设置的悬念、问题、困难、假设等,是悬念则释消,是问题则解决,是困难则克 服,是假设则证实或证伪。回应法使教学表现出更强的逻辑性,让学生豁然开朗,顿开茅 塞,同时还使学生产生一种“思路遥遥、惊回起点”的喜悦感,有助于增强学生进一步学习 的兴趣

在学习“一元二次方程根与系数的关系”内容时,有的老师在课题引入时采用“提出问 题,巧布悬念”,先出示小黑板:弟弟解一元二次方程x2・15x・100=0,得出两个根为20 和5。姐姐走过来,刚看了一眼就说:“你做错了。"姐姐是怎样看出来的?有的学生脱口而 出:“验根。”教师强调:由题意可知,姐姐是在一瞬间作出判断的,不可能是利用代入原 方程验根的方法。(学生点头)当老师讲完“一元二次方程根与系数的关系”——韦达定理 后,重新出示小黑板,让学生再次考虑课前提出的问题,学生恍然大悟,齐答:“是利用了 韦达定理。”

(十)点题法

点题法是教学结束时,在学生对教材进行了认真研读,对一些问题作了深入思考的基础 上,教师对教学内容直接或间接的说明、点拨,以表现、揭示主题的结课方法C

有位教师在结束课文《只有一个地球》时,就采用点题法:“我们只有一个地球,人类与大 自然是相互依存的关系,地球是我们的家园,人类只有保护好自己赖以生存和繁衍的大自 然,保护好生态环境,才能有幸福美好的发展前景;反之,如果不珍惜地球上的山山水 水、森林草原,比如污染水源、毁坏树木等,则会受到大自然的惩罚。因此,我们每个人 都要自觉地爱护大自然的一草一木,为保护、改善、美化人类的生存环境作出自己应有的 努力。

(十一)激疑、答疑法

激疑、答疑法是在新内容讲完后让学生提出问题,教师和学生一起回答问题的结课方 法。这种方法主要是让学生提出一些不太明白的问题,然后采用启发诱导的方式,帮助学生理解与解决问题。

运用这种方法结课,要求教师具有较高的教学调控能力,能引导学生提 出与教学内容相关的问题,并能引导学生对所激疑、答疑法是在新内容讲完后让学生提出问题,教师和学生一起回答问题的结课方 法。这种方法主要是让学生提出一些不太明白的问题,然后采用启发诱导的方式,帮助学 生理解与解决问题。运用这种方法结课,要求教师具有较高的教学调控能力,能引导学生 提出与教学内容相关的问题,并能引导学生对所提问题作出贴切的回答。

全国特级教师于漪有一次作公开课,讲《宇宙里有些什么》o讲完后让学生看书,提 问题。一位学生站起来问:“课文里…这些恒星系大约有一千万万颗以上的恒星、这里的 万万是多少? ”话音刚落,全班学生都笑了。提问题的学生也觉得问题提得不合适,谁不知 道“万万”是亿啊!于老师却笑着说:“这个问题不用回答,可能大家都知道了。可是我要 问:既然…万万”是亿,作者为什么不用一个…亿”字,反而用两个字…万万”呢?谁能解 释? ”教室里顿时静了下来。不一会儿,一个学生站起回答:“我也不懂,不过我想说说 看。我觉得用…万万”读着顺口,还有,好像…万万“比…亿,多。”于老师说:“讲得很好。 别的同学还想说什么吗?"当于老师确信没有不同看法后说:“通过对…万万”的讨论,我 们了解到汉字重叠的作用,它不但读起来响亮,而且增强了表现力。

(十二)发散法

发散法是引导学生对教学过程中得出的结论、命题、定律等进行进一步的发散性思考, 以拓宽知识的覆盖面和适用面,并加深学生对已讲知识理解的结课方法。这种结课法可使 教学的主题、内容得到进一步拓展,具有培养发散的创造性思维的作用。

一位历史教师在讲完《洋务运动》一课后,在小结时提出一个问题:“为什么洋务运动 时期,洋务派向外国资本主义国家购买了机器,引进近代的生产技术,却没有使中国走上 富强的道路? ”当学生作出回答后,教师又提出一个问题:“当前,我国为实现四个现代化 的需要,也引进外国的生产技术,但为什么却有利于四化建设呢? ”这就使学生在掌握所学 知识的基础上,思维又另起波澜,发散开去。

(十三)假想法

假想法是对课文作各种假设,让学生依据假设推断另外的结局,以此培养学生创造力 和想象力的结课方法。

讲完“蒸腾作用”一课后,可以提出这样的假设:“假如到了秋天,杨树、柳树等阔叶树的叶 子不落,结果会怎样? ”(这些树木只有落叶,尽量减少水分的蒸腾,才能安全过冬。要不 然,天寒地冻,树根吸水已经很困难,如果树叶的蒸腾作用照常进行,你们想想看,等待 树木的除了死亡还有什么呢?这个问题是假想的,而且是开放性很强的。学生会立即议 论、思考、提出各种可能等等。这样的结尾,可使学生的学习意犹未尽,余想不断。

(十四)拓展延伸法

拓展延伸法是指教师在总结归纳所学知识的同时,与其它科目或以后将要学到的内容 或生活实际联系起来,把知识向其他方面扩展或延伸的结课方法,以拓宽学生的知识面, 激发学生学习、研究新知识的兴趣。

教学“圆面积计算”结课时,教师拿出一张正方形的纸片,用剪刀剪成一个圆,问:“怎 样求它的面积? ”随即拿起剪去的部分,问:“怎样求它的面积? ”再用剪刀在圆纸片中任意 剪去一个三角形,问:“现在谁能求出它的面积? ”接着又用在圆纸片中分别剪去一个长方 形、正方形、梯形、小圆等,分别请学生求面积。然后再拿一张圆纸片,把它对折后问学 生:“会不会求它的面积? ”再对折后,问:“现在呢? ”再对折后,问:“还会吗? ”运用这种 方式结尾,学生感到兴奋、快乐、有趣,从而激起学生的求知欲。

(十五)汇报法

汇报法结课就是在一堂课结束时让学生汇报这堂课的学习收获,培养学生的自我评价 能力。让学生自己谈收获,学生兴趣浓,既能调动学生的积极性,又能使学生回顾本节课 所学内容,进一步掌握本堂课所学知识。

一位教师这样结束小学数学“千克的初步认识”一 课的教学:同学们以“今天学习了什么,有什么收获? ”为题各自发表自己的意见。 学生A:我认识了重量单位一一千克。 学生B:我学会了用台秤称物品的重量,以后上街买东西再也不会受别人骗了。 学生C:我知道称较轻的物品用克作单位比较合适,称较重的物品用千克作单位比较合 适.教师:刚才同学们学得很好。那么,如果要表示这头大象的重量,用克或千克作单位 合适吗?用什么作单位比较合适呢?这个以后我们再学习。 教师:刚才同学们学得很好。那么,如果要表示这头大象的重量,用克或千克作单位合适 吗?用什么作单位比较合适呢?这个以后我们再学习。

(十六)震颤式结课

老师用丰富的情感语言,触动学生的心灵深处,以分享教师的情感体验。有位老师在 《最后一课》教学结尾时,声情并茂的朗诵课文:“法兰西万岁”学生深情的注视着老 师,震撼学生的心灵

(十七)自然式结课

老师讲完最后一个内容或最后一句话,下课铃声正好响起。

七、结课的作用

结课技能是教师在一个教学内容结束或课堂教学任务终了阶段,通过重复强调、归纳总结和实践活动等方式回顾与概括所讲主要内容,强化学生学习兴趣,使学生形成完整的认知结构的教学行为

导课是“起调”,结课是“终曲”完美的教学必须做到善始善终,故结课技能和导课技能一样,是衡量教师教学技能高低的重要标志

一堂课的结束也是如此,结束的好坏直接影响课堂教学效果

精彩的新课引人,能产生“课伊始、趣已生”的效果,同样巧妙的结尾也可以达到“课虽尽,趣犹存”的境界

课堂小结不是课堂教学中可有可无的活动,而是必不可少的教学环节

一堂课要经历几个教学阶段,每个阶段都有各自的特点和任务,其中有主有次,而且后面的教学活动往往冲淡了前面的学习内容,学生一时难以形成完善的知识结构,也难以有效地储存知识信息